La Ley de Moore se pasa a la inteligencia artificial reduciendo su tamaño y duplicando su potencia

Ofrecido por Huawei

Cuando en 1965 la industria de los microprocesadores estaba a punto de vivir su mayor auge, Gordon Earl Moore uno de los que posteriormente se convertiría en protagonista de ese gran desarrollo, enunció su demoledora teoría que establecería el ritmo de crecimiento de la potencia de los procesadores.

La Ley de Moore expresa que, aproximadamente cada dos años se duplica el número de transistores en un microprocesador, lo que a su vez se traduce en mejoras a nivel de potencia y optimización de la energía utilizada para obtener esa potencia.

Esta ley, que se enunció en su día pensando en los procesadores, se puede extrapolar fácilmente al desarrollo de la inteligencia artificial, que cada año reduce su tamaño y mejora su eficiencia duplicando su potencia de procesado de información.

El saber sí ocupa lugar

El dicho castellano dice que “El saber no ocupa lugar”. Sin embargo, esto no es del todo cierto en este caso ya que un agente de inteligencia artificial puede necesitar un considerable espacio dentro de la memoria de un ordenador para funcionar.

De ahí que la miniaturización, a la que hace referencia la Ley de Moore, sea tan importante a la hora de hablar de inteligencia artificial.

Durante años, la inteligencia artificial se ha alojado en grandes servidores de empresas que ofrecían servicios de traducción a otros idiomas, reconocimiento facial o de objetos en dispositivos móviles. Para que estos servicios funcionaran debían enviarse los datos a esos servidores externos para que la inteligencia artificial los procesara y, después, se devolvía el resultado de los datos ya procesados de vuelta al smartphone.

La miniaturización de la inteligencia artificial y el aumento de su potencia está haciendo posible que dispositivos portátiles, como un smartphone o un altavoz inteligente, puedan ejecutar potentes algoritmos sin tener que enviar ninguna información a servidores externos.

Es lo que se ha denominado como Edge Computing, pequeños agentes de inteligencia artificial que operan dentro del propio procesador del dispositivo, permitiéndole funcionar a nivel local sin necesidad de comunicarse con ningún servidor externo.

Para llegar a este punto ha sido necesario un largo trabajo de optimización de los algoritmos en los que se basa la inteligencia artificial, para hacerlos más pequeños y necesitar menos parámetros para obtener el mismo resultado.

La inteligencia artificial y las mejoras en los procesadores van de la mano

El principal objetivo de la inteligencia artificial es imitar el razonamiento lógico del cerebro humano, un sistema impulsado por entre 80 y 100 mil millones de neuronas con millones de años de evolución para hacer su trabajo de forma eficiente.

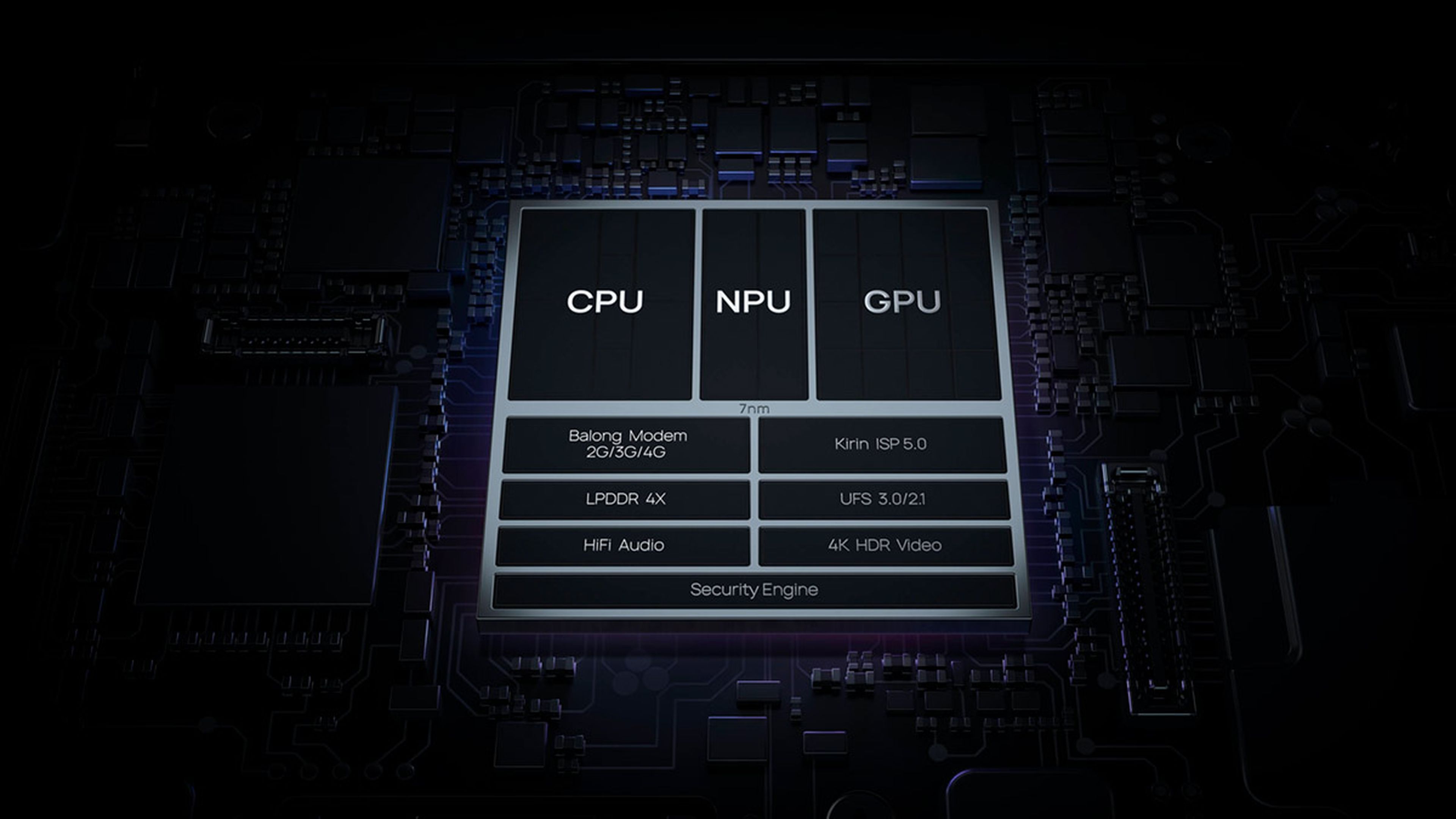

Tratar de emular el procesamiento del cerebro no es algo sencillo, pero últimamente se han acelerado su proceso, una vez más gracias a la Ley de Moore, consiguiendo desarrollar unidades de procesamiento neural (NPU por sus siglas en inglés) de un tamaño lo suficientemente pequeño como para integrar esa inteligencia artificial en el procesador de un smartphone.

Huawei es uno de los que más está apostando por incluir este tipo de núcleos de procesamiento neural, que haciendo honor a la Ley de Moore, en solo dos generaciones de su procesador Kirin de la serie 900 ha logrado pasar de una unidad NPU que contaba su Kirin 970 a la NPU de doble núcleo que integra el procesador Kirin 990 que montan los nuevos smartphones de la marca como el Huawei Mate 30.

Al contar con un procesador dedicado exclusivamente al procesado de datos relacionados con la inteligencia artificial, los dispositivos móviles han dejado de depender de los servidores externos reduciendo así la necesidad de transferir datos fuera del ámbito del propio smartphone.

De ese modo, no solo se mejora la capacidad de los agentes de inteligencia artificial sin que esta mejora afecte al rendimiento del smartphone, sino que también se logra una mejora en la privacidad de los datos, ya que no salen del dispositivo.

Ley Moore y la inteligencia artificial

Hemos podido ver que la Ley de Moore se aplica al desarrollo de los procesadores neurales de la misma forma que lo hace en los procesadores convencionales, aplicando su ritmo implacable de miniaturización.

Sin embargo, ese proceso también se está empezando a aplicar a la parte de software de la inteligencia artificial, de forma que los agentes de inteligencia artificial cada vez se hacen más ligeros y “portátiles”, pero manteniendo las mismas características que las versiones más pesadas.

A este proceso de reducción se le denomina Destilación de conocimiento y se basa en desarrollar un agente de inteligencia artificial llamada Maestro entrenándolo con varios millones de parámetros para que realice una determinada función.

Cuando su entrenamiento ha finalizado, entra en juego un segundo agente de inteligencia artificial llamado Estudiante, que se entrena con los parámetros del Maestro, para luego modificarlo hasta conseguir que sus resultados coincidan con los del Maestro.

Con esto se logra que ambos agentes obtengan los mismos resultados, pero con una gran diferencia de tamaño y rendimiento en el alumno, que se ha ahorrado todo el proceso de aprendizaje del maestro.

Gracias a este proceso, Huawei ha logrado desarrollar TinyBERT, un proyecto basado en el agente de inteligencia artificial BERT de Google que fue entrenado con 100 millones de parámetros el cual, mediante este proceso de Destilado de conocimiento, Huawei ha logrado reducirlo a una séptima parte del tamaño original haciendo que TinyBERT procese la información casi 10 veces más rápido que el agente Maestro.

La miniaturización de los agentes de inteligencia artificial ayudará a llevar los últimos avances de inteligencia artificial a los dispositivos de los consumidores.

De este modo, las próximas generaciones de móviles de Huawei podrían incorporar sistemas generación de lenguaje y predicción de texto más potentes que las que existen en la actualidad, mejorando innumerables aplicaciones como los asistentes de voz, la optimización del funcionamiento del dispositivo o facilitar todavía más las compras online desde el smartphone.

Descubre más sobre Business Solutions, autor/a de este artículo.

Conoce cómo trabajamos en Computerhoy.