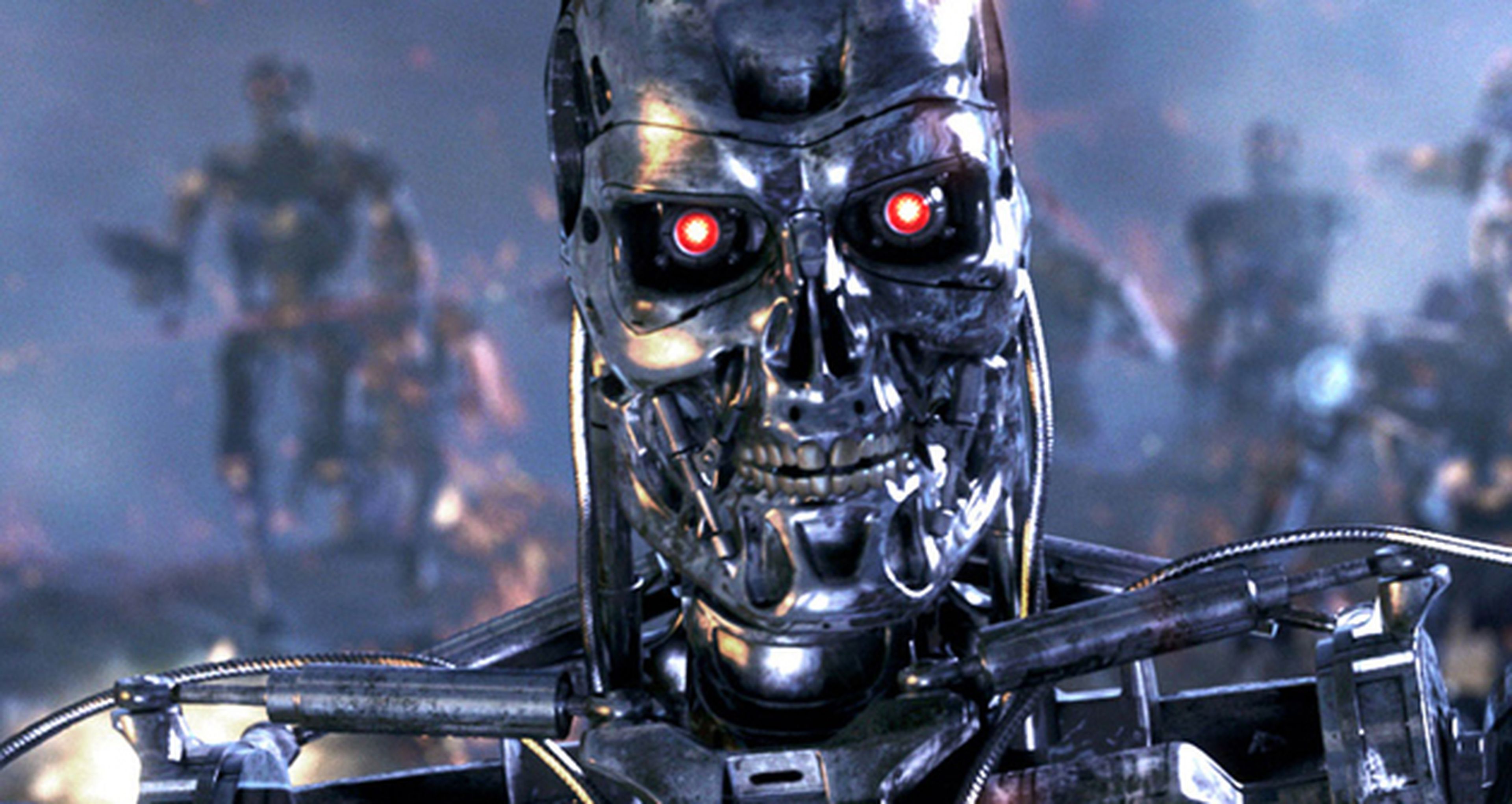

150 compañías se unen para evitar el desarrollo de robots asesinos

Evitar que el desarrollo de la inteligencia artificial (IA) y la robótica se use para armamento y finalidades "letales": este es el mensaje principal del juramento que han firmado más de 2.400 personas de empresas de todo el mundo. Entre ellas hay representantes de compañías como DeepMind (Google) o incluso el propio Elon Musk.

La firma se ha realizado en la Conferencia Conjunta Internacional de Inteligencia Artificial de 2018 que ha tenido lugar recientemente en Estocolmo. Se trata de un congreso que organiza el Future of Life Institute, el cual ha pedido a los gobiernos, academias y el resto de la industria "crear un futuro con fuertes normas internacionales contra las armas letales autónomas".

"La inteligencia artificial tiene un enorme potencial para ayudar al mundo, si estigmatizamos y prevenimos su abuso. Las armas inteligentes que matan a personas de manera autónoma son tan repugnantes y desestabilizadoras como las armas biológicas y deberían tratarse de la misma manera" ha dicho el presidente del Future of Life Institute y profesor de física en el MIT, Max Tegmark.

Entre las 2.400 firmas que ya ha recogido el juramento, hay representantes de compañías tecnológicas como Google DeepMind, la Fundación XPRIZE, ClearPath Robotics y la Asociación Europea para la IA. También ha firmado el manifiesto, Elon Musk que lleva años alertando de los peligros que puede suponer para la humanidad el mal uso de este avance tecnológico.

Esta iniciativa surge a raíz de que se hiciera público que la Universidad KAIST, un centro de ciencia y tecnología de Corea, planeaba abrir un laboratorio de armas inteligente en colaboración con Hanwha Systems, empresa armamentística.

Ante esta noticia, un grupo de 50 investigadores de 30 países organizaron un boicot contra el centro universitario, el cual se apresuró a negar el proyecto: "KAIST no tiene ninguna intención de involucrarse en el desarrollo de sistemas autónomos letales como armas y robots asesinos", dijo el presidente del KAIST, profesor Sung-Chul Shin a ScienceInsider.

Todo avance científico o tecnológico tiene sus pros y sus contras, y tecnologías tan poderosas como la inteligencia artificial puede dar muchos beneficios a la sociedad pero también convertirse en una auténtica pesadilla. Por eso no es de extrañar que cada poco tiempo salgan voces expertas pidiendo precaución a los investigadores y una regulación potente que establezca límites seguros para la humanidad.

Conoce cómo trabajamos en ComputerHoy.

Etiquetas: Destacado