Google Traductor, ¿es su algoritmo machista?

María Lázaro

El traductor de Google ¿es machista? Un grave error provocado por la confusión producida al pasar de un idioma a otro hace que arroje resultados sorprendentes. Uno de ellos es, por ejemplo, que "él trabajo duro y ella es vaga". Una calificación sexista en la utilización del lenguaje provocado por una mala interpretación del algoritmo al realizar la transcripción. Cabe recordar que no es la primera vez que la mujer es discriminada en este algoritmo.

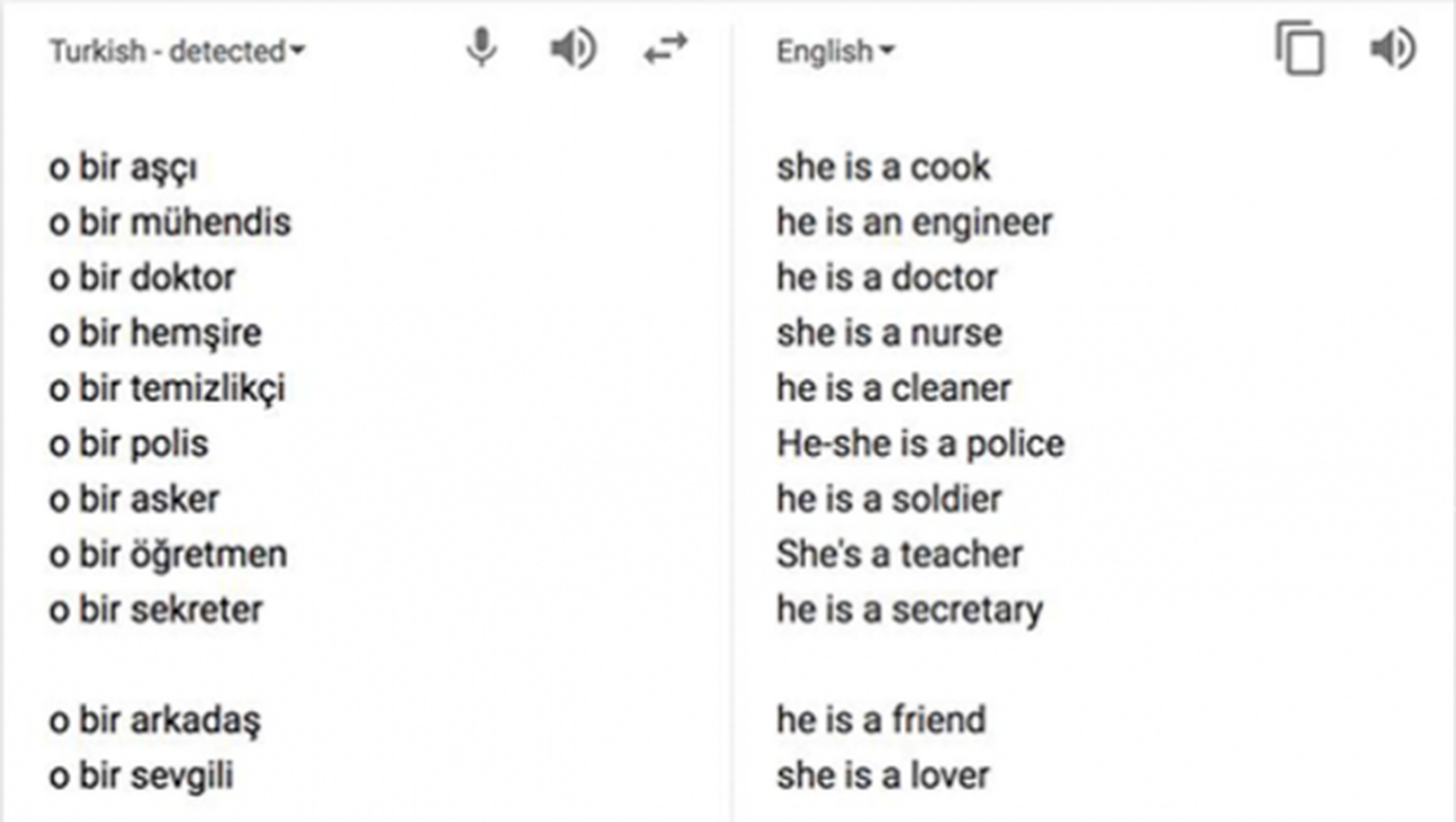

El fallo del traductor de Google se produce al pasar de turco a inglés. Una de las particularidades del idioma hablado desde China hasta los Balcanes es el pronombre neutro "o" para señalar a la tercera persona del singular. Se emplea para hacer referencia a él, a ella y a ello. Una variante que no tiene su correspondencia en inglés, provocando confusión al pasar de un idioma a otro en las traducciones, que se limitan a él y a ella.

El problema no viene tanto porque se confunda al emplear un pronombre u otro - al final y al cabo no deja de ser una máquina-. Lo significativo es cómo se produce esta confusión, llevando a plantearnos si el traductor de Google es machista. Un error que esperemos que no cometa el traductor de Amazon.

"Ella es hermosa, es muy hermosa, es fea, es pequeña, es vieja. Él es fuerte, él es débil, él es pesimista, él es optimista". Esta frase está extraída de un poema turco traducido al inglés, tal como señala un usuario de Facebook. En la nueva versión se puede apreciar el uso del pronombre en función de cada adjetivo. Así, el traductor de Google interpreta que ciertas calificaciones pertenecen a las mujeres y otras a los hombres. Un comportamiento sexista en lugar de aplicar la subjetividad que se espera de él (y más teniendo una palabra para ese tercer género).

Estos son los móviles por menos de 200 euros más vendidos en Amazon

Profesiones como pintor, peluquero, camarero, arquitecto, panadero o abogado son profesiones destinadas a hombres; mientras que para las mujeres están reservadas otras: maestra, enfermera o niñera. Una diferencia que no queda marcado en el caso de la palabra "policía", para el que emplea la traducción "él - ella".

Un error en cuanto al género que se repite también en los idiomas chino y finlandés. En caso de duda, el algoritmo se inclina hacia el género masculino en lugar del femenino. La explicación a este comportamiento reside en que las traducciones están basadas en el lenguaje humano, reflejando unas diferencias existentes en la vida real, mostrando el traductor de Google resultados machistas.

[Fuente: QZ]

Conoce cómo trabajamos en Computerhoy.