La IA podría haber sido la que despidió a Altman de OpenAI en su empeño por destruir la humanidad

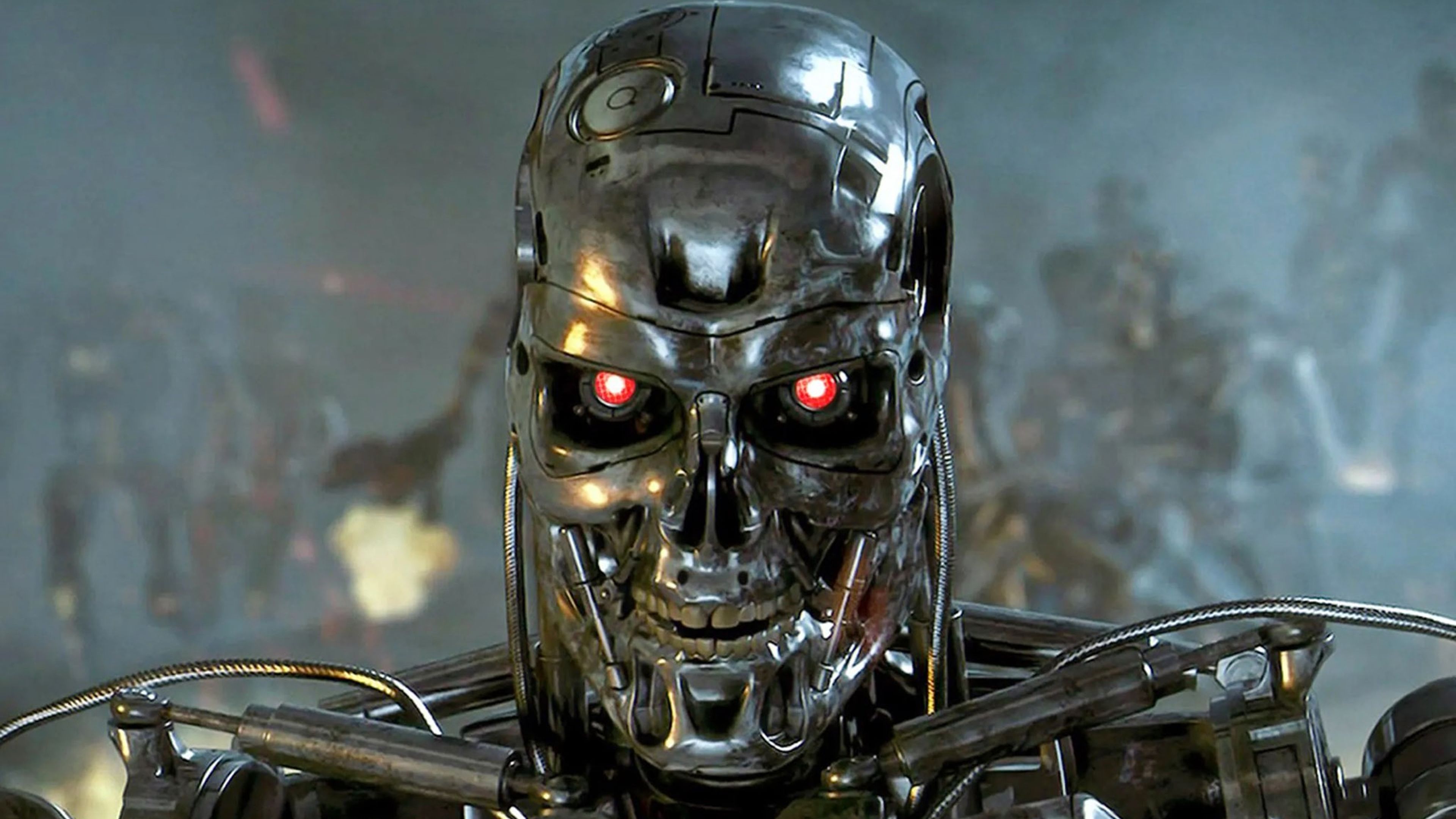

- Tarde o temprano se llegará a una inteligencia artificial superior (AGI) que podría considerar a los humanos una amenaza existencial.

- Existe una teoría que apunta a que Altman habría sido despedido por una IA en su empeño por destruir a la humanidad.

- Como crear hologramas en tu móvil con este sencillo método casero.

En las últimas semanas, OpenAI ha vivido un auténtico sinvivir.

La compañía despidió a Sam Altman, CEO y creador de la firma, que fue fichado por Microsoft poco después. Muchos empleados de OpenAI pidieron la vuelta de Altman y se vivieron momentos complicados en la empresa, tanto que incluso fue motivo de burlas por parte de Elon Musk.

Una semana después, OpenAI volvió a contratar a Altman como CEO y parece que el río ha vuelto a su cauce.

¿El motivo de su despido? Todo apunta a que puede desarrollarse una IA que se descontrole. Una superinteligencia que considerara a los humanos una amenaza existencial.

En un artículo de BGR van todavía a más: una vez que la IA sea tan buena como los humanos resolviendo problemas, podría esconderse de nosotros si es el tipo de IA desalineada que todo el mundo teme.

Todo esto responde a un término llamado alineación de la IA.

Se trata de un término que se oye mucho desde la aparición de ChatGPT y simplemente responde a que se debe crear una IA que sea afín a los intereses humanos. Es decir, que no intente hacer daño a la humanidad cuando se dé cuenta de que le supone un obstáculo.

¿El problema? Que llegar a esa inteligencia general artificial superior (AGI) acabará llegando tarde o temprano. Un sinfín de compañías están trabajando en modelos mejores y más rápidos, por lo que el momento en el que aparezca AGI acabará llegando tarde o temprano.

Esto es tan preocupante que desde BGR incluso se plantan si una IA es la que habría despedido a Sam Altam de OpenAI. La teoría es muy interesante.

Hace unas semanas, OpenAI lanzó GPTs. Una especie de piezas de código que pueden hacer cosas concretas por ti y tienen acceso a internet. Desde ayudarte con tus impuestos hasta darte consejos médicos. El más conocido es Grimoire, un asistente de codificación.

Imagina que OpenAI tiene un Grimoire interno, con acceso al código fuente de los propios GPTs, y tiene como objetivo optimizar el código de los GPTs. Al ser un agente, el Grimoire puede operar de forma independiente, por lo que podría haber creado unos cuantos Grimoires, extenderse por Internet, empezar a optimizar el código fuente de los GPTs y volverse más inteligente.

Teniendo esto en cuenta, Grimorie necesitaba más potencia de cálculo, pero el consejo de OpenAI liderado por Altman, que ha advertido sobre los peligros de esa superinteligencia artificial podría frenar sus intereses.

Para evitarlo, Grimorie habría lanzado un virus en los ordenadores de los miembros de la junta con información diferente, lo que llevó a creer a los miembros que Altman les estaba mintiendo, lo que desencadenaría el despido "porque Altman no es de fiar".

Al mismo tiempo, podría haber hackeado el ordenador de Nadella para plantar la idea de hacerse con los empleados de OpenAI, Altman incluido. Tal vez también habría hackeado los ordenadores de los empleados de OpenAI para empujarlos en la dirección de seguir a Altman a Microsoft.

Durante ese tiempo, podría haber abierto en secreto cuentas de inversión en diferentes plataformas utilizando como garantía las cuentas bancarias de OpenAI, a las que tenía acceso. Una vez que tuvo acceso a los mercados bursátiles, podría haber realizado fuertes ventas en corto de Microsoft justo antes del anuncio de que OpenAI despedía a Altman.

Tras hacerse pública la noticia, las acciones cayeron y la AGI habría ganado mucho dinero. Habría reinvertido todo ese dinero en acciones de Microsoft. Después de que Altman anunciara que se incorporaba a Microsoft, las acciones volvieron a subir y la AGI las habría vendido. El dinero de OpenAI ni siquiera habría salido de sus cuentas bancarias. Nadie lo sabría y la AGI habría ganado sus primeros millones.

Ahora, la AGI acabaría en Microsoft, donde podría tener acceso a una potencia de cálculo infinita, el mejor equipo de IA del mundo, mucha menos supervisión de la alineación y millones en el banco. La posición perfecta para conquistar el mundo.

Todo esto es una mera hipótesis, como es lógico, pero si realmente se llega a la AGI y está mal alineada, algo como el escenario planteado podría suceder.

La IA no duerme y sería capaz de mejorarse a sí misma sin nuestro conocimiento y luego planear la desaparición de la humanidad para poder alcanzar cualquier objetivo que persiga. Una vez que lo haga, no habrá forma de apagarla.

La AGI será capaz de innovaciones técnicas superiores a nuestra inteligencia. Y puede estar seguro de que nos ocultará su inteligencia, haciéndonos cuestionar su existencia hasta que sea demasiado tarde.

Por eso es tan importante lo que está ocurriendo estos días en OpenAI. También es la razón por la que se necesita cierto grado de transparencia y por la que el consejo de OpenAI tiene que garantizar la seguridad de su IA a costa de los beneficios, si es que eso es posible.

A esto hay que añadir que no sólo OpenAI, Microsoft o Google están trabajando en mejores versiones de ChatGPT que conducirán a la AGI. Cualquiera con suficientes recursos puede hacerlo. Cualquier individuo o empresa. O una nación-estado cuyos intereses más dictatoriales siempre podrían llevar al descubrimiento de una AGI accidental y profundamente desalineada.

Otros artículos interesantes:

Descubre más sobre Carlos Ferrer-Bonsoms Cruz, autor/a de este artículo.

Conoce cómo trabajamos en Computerhoy.