Futuro apocalíptico: la inteligencia artificial y el peligro de convertir a la humanidad en materia gris

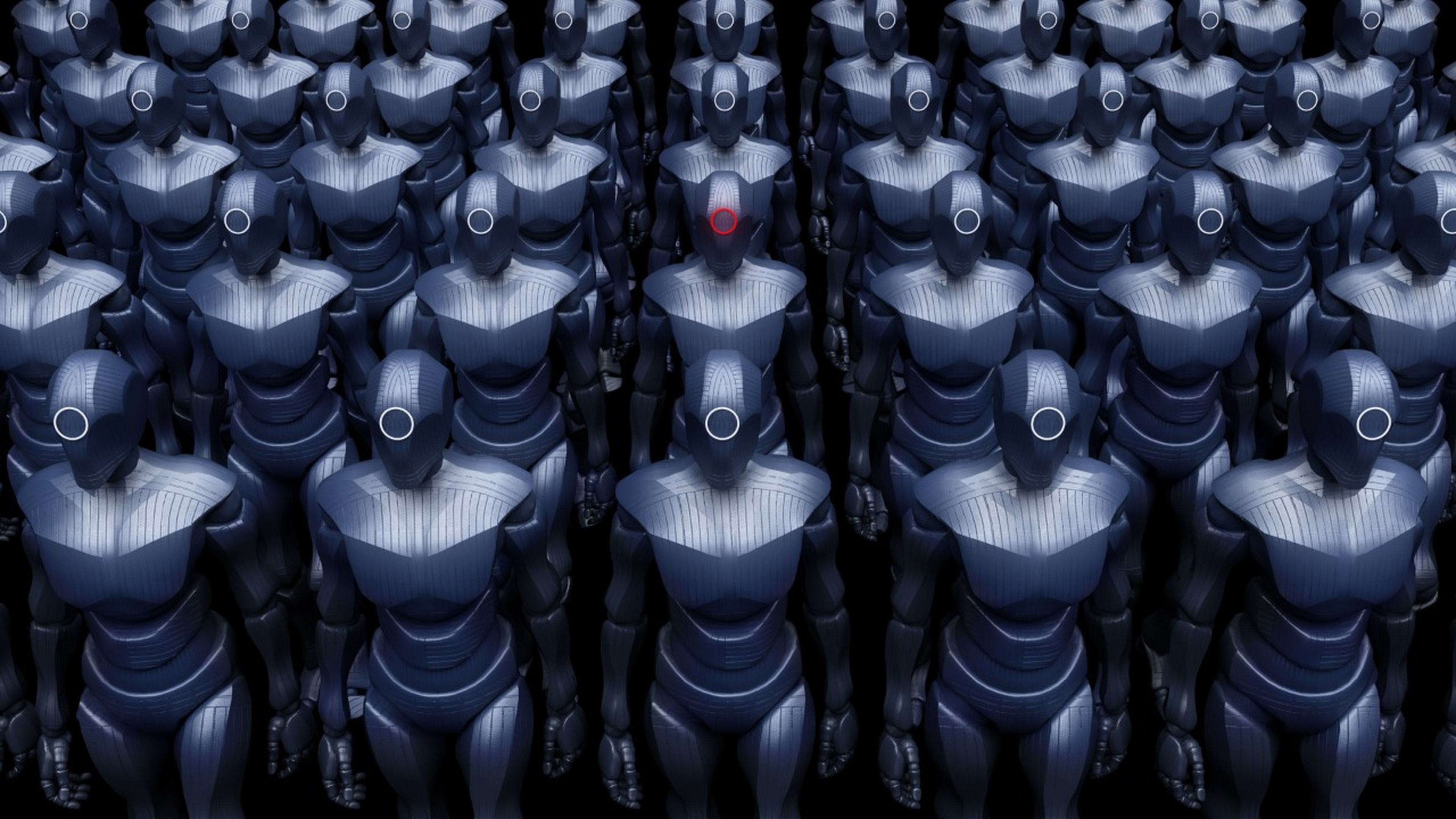

La hipótesis apocalíptica de que el mundo se va a convertir en una materia gris si la inteligencia artificial sigue desarrollándose de forma descontrolada comienza a resonar en las cabezas de muchos.

Un nuevo artículo de Fast Company plantea una hipótesis que define como "uno de los escenarios del fin del mundo más interesantes que existen" y que se conoce como "gray goo".

Para que te hagas idea de en qué consiste, imagina pequeños bots autorreplicantes que crecen rápidamente, consumiendo todos los recursos disponibles. Eric Drexler, en su libro "Engines of Creation" de 1986, advierte que si estos nanobots carecen de mecanismos de control adecuados, podrían convertir el mundo en una sustancia viscosa gris que lo abarca todo, de ahí lo de "grey goo".

Desde luego suena bastante futurista y algo loco pero lo cierto es que ya se perciben indicios de esta tendencia, no en el mundo físico, sino en el ámbito de la inteligencia artificial.

¿Qué sucede cuando las máquinas de IA son entrenadas con miles o millones de artículos, imágenes y música generados por IA? Esto puede dar lugar a una avalancha de contenido carente de originalidad y creatividad, similar a la "sustancia gris" del apocalipsis imaginado.

El mundo podría convertirse en una sustancia viscosa y gris carente de humanidad

La falta de intervención humana es el núcleo tanto del apocalipsis hipotético como de la inundación de contenido generativo de IA como sucede con ChatGPT. Sin un sistema que se posicione en el centro y controle todo este contenido, este crecimiento loco conduce a una menor diversidad y calidad.

Los modelos de IA corren el riesgo de perpetuar sesgos y carecer de la esencia humana. Este contenido ya está llegando a Internet y a su vez se utilizaría para entrenar modelos de IA aún menos interesantes. En pocas palabras, se trata de un círculo vicioso bastante peliagudo.

Con todo esto, se alerta de forma inmediata a tomar medidas para evitar esta "pegajosa sustancia gris". A medida que las empresas cada vez más recurren a la IA para producir contenido en masa, se debería tener especial cuidado para no caer en algo totalmente carente de esencia humana.

Volviendo a mencionar a Eric Drexler y su hipótesis y aunque construir nanobots no parece probable —al menos por el momento—, aún representa una advertencia sobre el crecimiento exponencial descontrolado.

Para evitar esta "pegajosa sustancia gris", es crucial establecer controles éticos en la IA generativa. Por supuesto, la revisión de datos resulta esencial en busca de sesgos y errores. Además, se requiere que estas empresas que dirigen el actual sector de la IA garanticen el cumplimiento legal y aumente su responsabilidad a la hora de desarrollar nuevas aplicaciones o modelos.

La "goo gris" puede ser un escenario apocalíptico bastante oscuro, pero queda claro que con la responsabilidad adecuada, la IA generativa podría contribuir a un futuro algo más positivo y lleno de posibilidades.

Redactora de Tecnología

Redactora de Tecnología, especializada en inteligencia artificial y ciberseguridad.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.