Nvidia presenta su nueva generación de chips para IA Blackwell B200, cuatro veces más potente que H100 y 25 veces más eficiente

NVIDIA

- Nvidia acaba de presentar su nueva generación Blackwell de GPU centradas en la inteligencia artificial.

- Asegura que son mucho más potentes y más eficientes que la actual generación Hopper, que domina el 90% del mercado de IA.

Gracias a sus chips H100 para la inteligencia artificial, Nvidia ya vale más en Bolsa que Amazon o Google. Y espera reforzar ese dominio con la nueva generación Blackwell, que de momento se estrena con dos nuevas GPU: B200 y GB200.

Nvidia ha asegurado en la presentación, que sus nuevos chips B200 y GB200 son hasta cuatro veces más potentes y, lo más importante, 25 veces más eficientes que los H100.

Ha puesto un ejemplo muy significativo: para entrenar un modelo de 1,8 billones de parámetros antes se necesitaban 8.000 GPU H100 y 15 MW de potencia. Ahora bastan 2.000 GPU Blackwell B200 para hacerlo con un consumo de solo 4 MW.

La inteligencia artificial exige mucha potencia de proceso para entrenarla, y para funcionar, ya que evalúa billones de parámetros por segundo. Las GPU de Nvidia especializadas en IA, A100 y H100, han demostrado ser las que mejor relación rendimiento / precio ofrecen, y por eso más de 90% de las aplicaciones y servicios de IA, usan chips de IA de Nvidia.

La actual generación tiene un gran problema: consumen demasiado. Tanto en electricidad como en agua para refrigerar los chips de los centros de datos. Se estima que unas pocas consultas a ChatGPT consumen el equivalente a una piscina de agua. ¿Cuántas consultas intrascendentes has hecho?

Nvidia Blackwell B200: la nueva generación de chips para IA

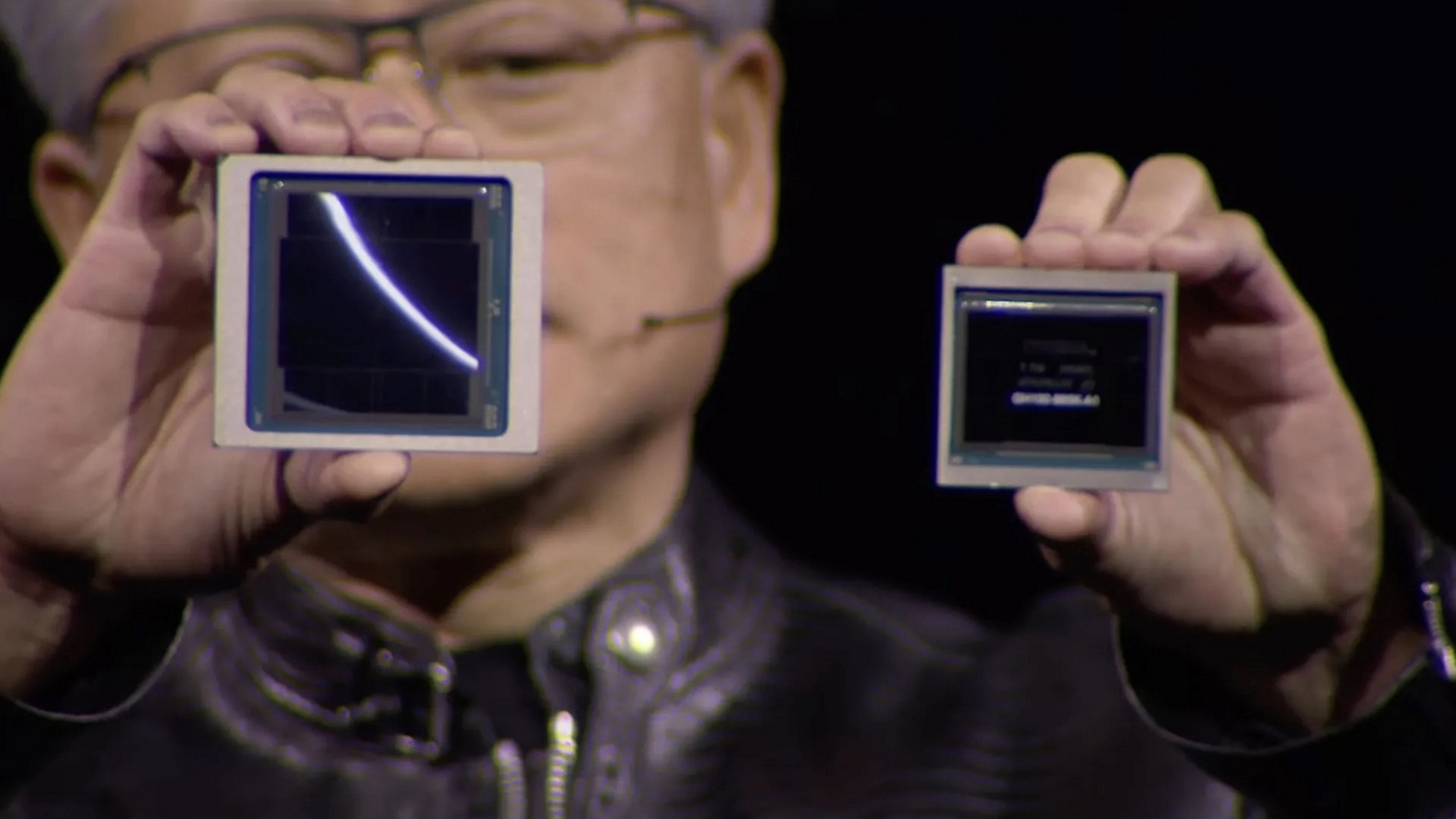

La nueva GPU B200 dispone de 208.000 millones de transistores, y alcanza una potencia de 20 PetaFLOPS en operaciones FP4.

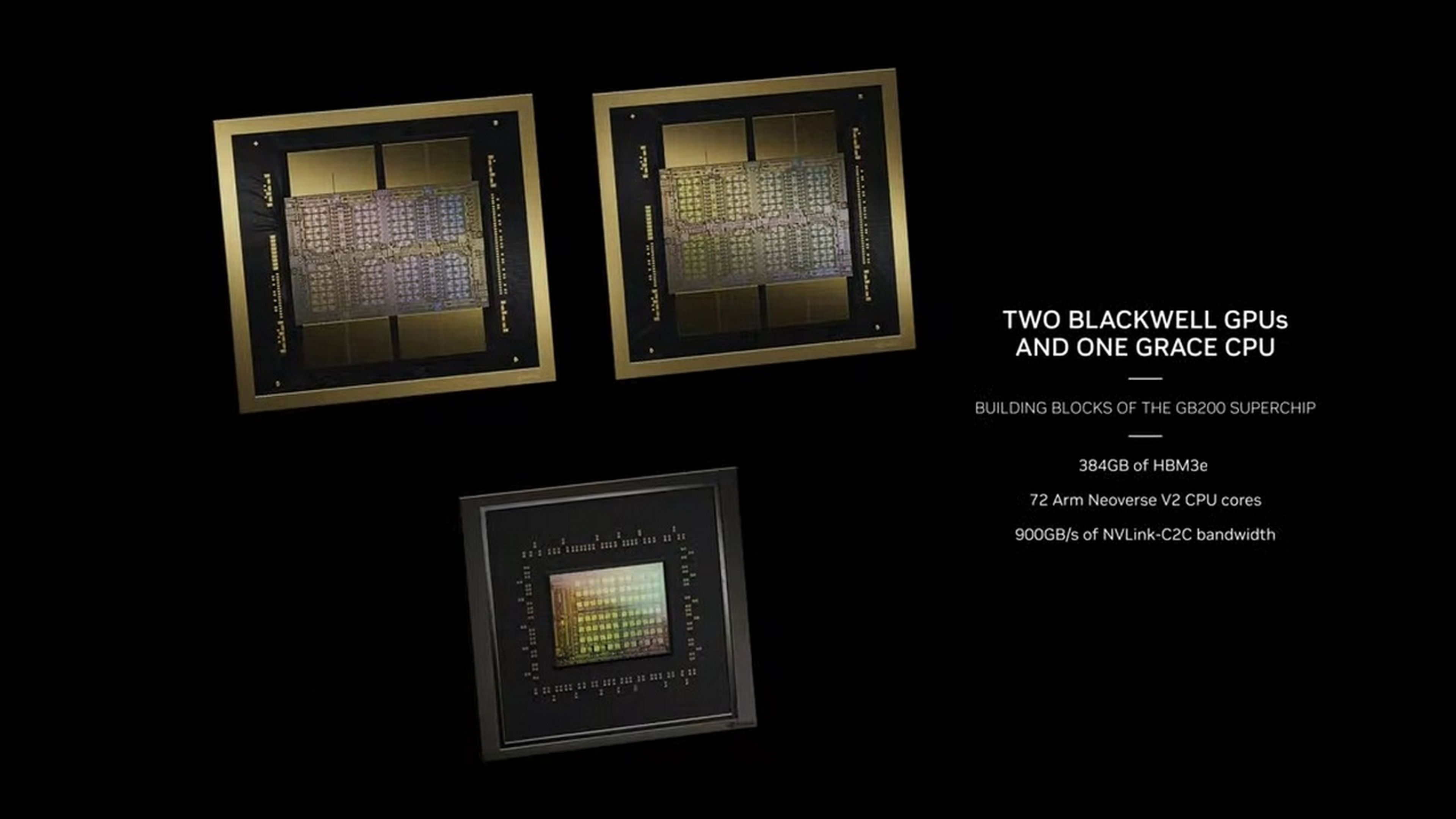

GB200, por su parte, es un chip formado por dos GPU B200 y una CPU Grace, y ofrece "30 veces más rendimiento para cargas de trabajo de inferencia LLM", según Nvidia.

El CEO de la compañía, Jen-Hsun Huang, ha afirmado que esta nueva generación "reduce el coste y el consumo de energía hasta 25 veces", con respecto a una H100.

¿Cómo consigue Nvidia estos resultados? Además del inevitable aumento de velocidad y densidad de transistores, Nvidia ha explicado que utiliza un motor de transformación que emplea cuatro bits para cada "neurona", en lugar de ocho, duplicando el rendimiento y ancho de banda.

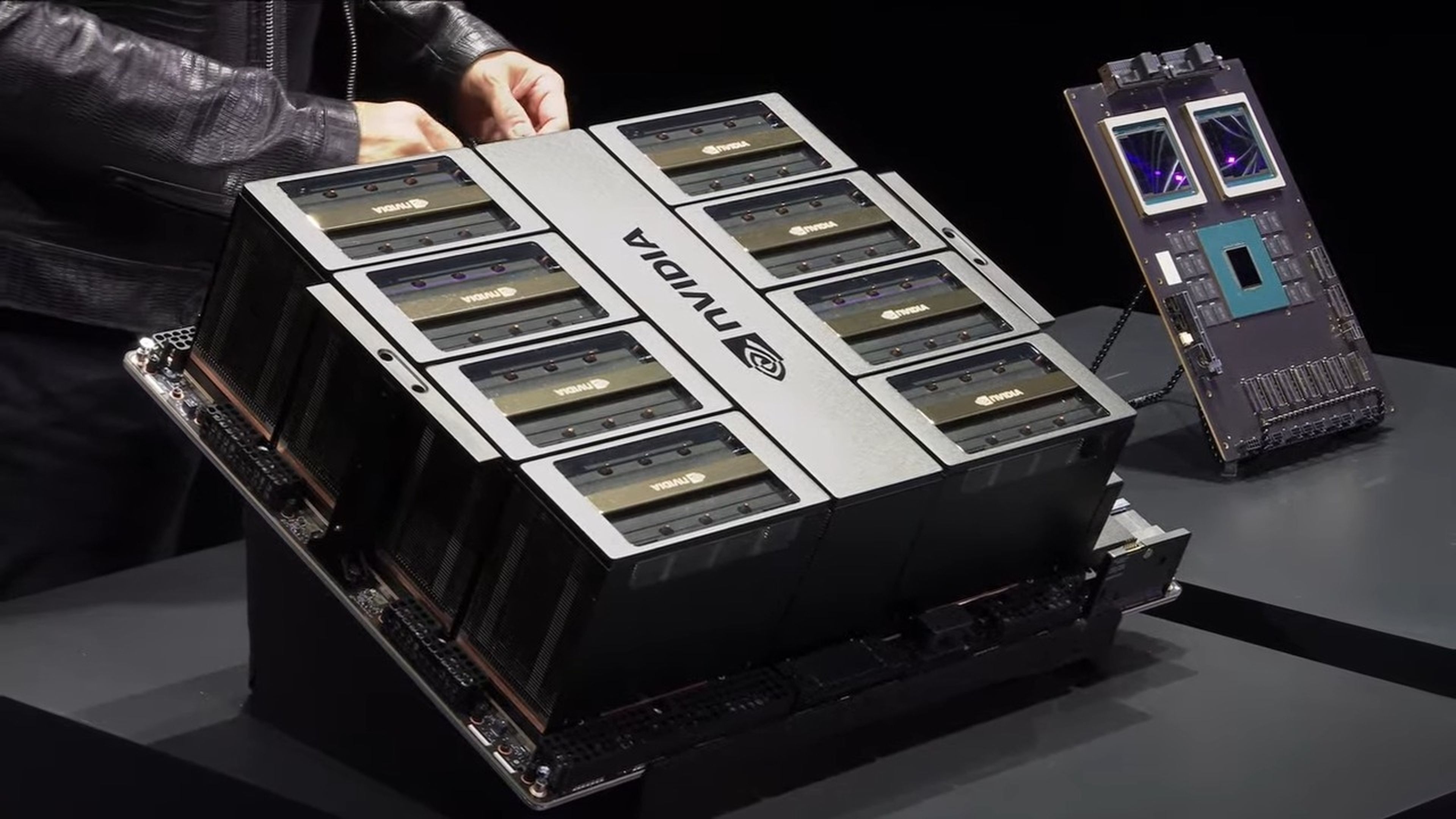

También ha mejorado mucho el conmutador NVLink, que permite a docenas de estas GPU trabajar en paralelo. En la anterior generación, un clúster de sólo 16 GPU dedicaba el 60 por ciento de su tiempo a comunicarse entre sí y solo el 40 por ciento a procesar datos. Con Blackwell, el tiempo de comunicación entre chips se ha reducido mucho.

Compañías como Intel o AMD prometen ponerle las cosas difíciles a Nvidia. Pero con esta nueva generación de GPU para IA, Blackwell B200, Nvidia demuestra que sigue muy por delante de la competencia. Amazon, Google, Microsoft y otras compañías, ya han hecho pedidos de estos nuevos chips.

Otros artículos interesantes:

Descubre más sobre Juan Antonio Pascual Estapé, autor/a de este artículo.

Conoce cómo trabajamos en Computerhoy.