Aprobada en la Unión Europea la primera ley de inteligencia artificial del mundo: ¿Se considera un éxito o será todo un fracaso?

- La aprobación de la ley de inteligencia artificial por parte de la Unión Europea marca un hito en el ámbito de la regulación de esta tecnología, posicionándola como líder al establecer un marco ético y legal para el desarrollo y uso de la IA.

- Sin embargo, todavía hay dudas: ¿Se ha adelantado demasiado la UE? ¿Llega esta ley a tiempo? ¿Cómo la percibirán otros países como China o Estados Unidos?

- Este canal reemplazará a los presentadores humanos por inteligencia artificial y es demasiado realista.

En un hito histórico y bastante costoso, la Unión Europea ha alcanzado un acuerdo provisional sobre la primera ley integral de inteligencia artificial del mundo. Tras tres días de negociaciones intensas, los Estados miembros y el Parlamento Europeo llegaron a un consenso que aún requiere ratificación, pero que se espera entre en vigor a finales de 2026.

Este reglamento busca establecer normas para garantizar la seguridad y el respeto de los derechos fundamentales en el uso de la inteligencia artificial, convirtiendo a la UE en un referente global en la regulación de esta tecnología que no para de evolucionar y crecer exponencialmente.

La presidencia española del Consejo de la UE afirmó que el objetivo de la ley es asegurar que los sistemas de IA utilizados en la UE sean seguros y respeten los valores europeos. La flexibilidad es una característica clave de este marco legal "a prueba del futuro", diseñado para regular funciones y tecnologías aún desconocidas y adaptarse a los cambios en las ya existentes.

Sin embargo, las negociaciones revelaron diferencias en la percepción de riesgos y excepciones, complicando los negociadores para encontrar un equilibrio entre la protección de derechos individuales y la no obstaculización de la economía y los intereses estatales.

"La tecnología de IA avanza a un ritmo acelerado, y la legislación que no sigue el mismo ritmo corre el riesgo de quedar obsoleta rápidamente", explica en una entrevista para Computer Hoy Josué Pérez Suay, especialista en Inteligencia Artificial y ChatGPT. "Al ser la primera de su tipo, la Ley de IA de la UE tiene el potencial de establecer un estándar global para la regulación de la IA. Esto puede influir en cómo otros países y regiones abordan sus propias regulaciones en el futuro", añade.

La presidenta de la Comisión, Ursula von der Leyen, calificó la normativa como "pionera en el mundo", un marco legal único para el desarrollo confiable de la IA. Roberta Metsola, presidenta del Parlamento Europeo, la consideró una legislación vanguardista y responsable que establece estándares globales.

La ley aborda temas bastante controvertidos, como la regulación de modelos de IA como ChatGPT y la vigilancia biométrica

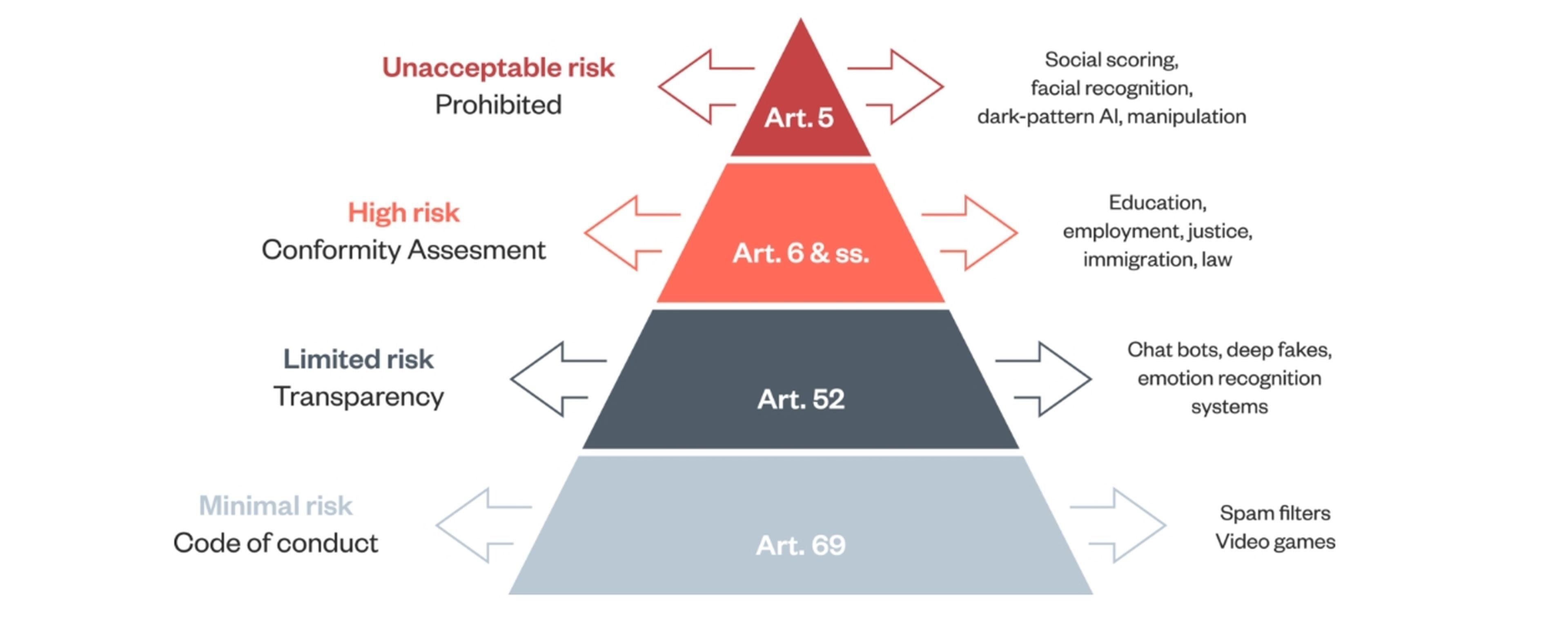

La normativa establece una clasificación crucial según el riesgo que representa, dividiéndola desde "riesgo mínimo" hasta "riesgo inaceptable", algo de lo que se lleva hablando ya varios meses.

Este marco regulatorio aborda específicamente usos peligrosos de la IA, imponiendo prohibiciones en ciertas aplicaciones y requisitos rigurosos para otras, especialmente aquellas relacionadas con infraestructuras críticas.

Por ejemplo, se prohibirán sistemas biométricos basados en la raza, creencias políticas, religiosas, orientación sexual y emociones en el lugar de trabajo. La vigilancia biométrica en tiempo real se permitirá solo para las fuerzas del orden con estrictas pautas y autorización judicial.

La legislación también se ocupa de los modelos generativos de IA, como ChatGPT, introduciendo reglas específicas para garantizar la transparencia y la gestión de riesgos. El Parlamento Europeo ha logrado imponer obligaciones más estrictas para los modelos de "alto impacto", que incluyen evaluaciones de riesgos, informes de incidentes y garantías de ciberseguridad.

Otro aspecto clave que aborda la legislación es la relación entre la IA y los derechos de autor. La ley exige que los sistemas y modelos de IA respeten los requisitos de transparencia y cumplan con la normativa de la UE sobre derechos de autor.

La normativa contempla sanciones para asegurar su cumplimiento, incluyendo multas que van desde los 35 millones de euros o el 7% del volumen de negocios global de la empresa hasta los 7,5 millones de euros o el 1,5% del volumen. Además, se establecerá una Oficina de IA independiente, asesorada por un panel científico y la sociedad civil, para supervisar su aplicación.

Entonces, ¿es un gran logro de la UE al ser pionera o se trata más de una desventaja que un beneficio?

Mirando el lado bueno, las reglas de la UE tratan temas éticos y derechos fundamentales relacionados con la inteligencia artificial. La clasificación por riesgo y las restricciones específicas, como en la vigilancia biométrica, podrían ser vistas como medidas para proteger la privacidad y los derechos de la gente.

Además, la transparencia y las responsabilidades impuestas a los modelos de IA importantes podrían impulsar un uso más responsable de la tecnología.

"Una regulación como esta es muy necesaria y, posiblemente, llega tarde. La IA ya está impactando en áreas críticas como la privacidad, la seguridad, el empleo y la ética. Por otro lado, regular una tecnología emergente y en constante cambio es complicado. Existe el riesgo de que regulaciones prematuras puedan frenar la innovación o no aborden adecuadamente los desafíos futuros que aún no se han manifestado completamente", explica el experto.

Sin embargo, algunos críticos afirman que reglas tan detalladas podrían frenar la innovación y desarrollo de la IA. Las exigencias extra a los modelos generativos, como ChatGPT, podrían aumentar la carga para los desarrolladores y limitar la libertad de hacer nuevas aplicaciones.

También hay preocupación debido a que reglas muy estrictas podrían afectar la competitividad de las empresas europeas comparadas con aquellas en países con normas más flexibles como China o EEUU.

En cuanto a cómo percibirán estos dos países esta nueva ley, China, que ha mostrado una fuerte inversión y desarrollo en tecnologías de inteligencia artificial, podría ver las regulaciones de la UE como un enfoque positivo en términos de protección de derechos y valores éticos, aunque también podrían cuestionar su impacto en la innovación.

Estados Unidos, por su parte, ha implementado medidas éticas y estrategias en el país, pero no una legislación tan detallada hasta ahora.

La reacción estadounidense podría variar entre el interés en aprender de las regulaciones europeas, ver en qué fallan y la preocupación por posibles impactos en la competencia global. "Podría optar por un enfoque más orientado al mercado, con menos regulaciones gubernamentales, dado su historial en áreas como la privacidad de datos y la regulación tecnológica", comenta el experto.

"La efectividad de la ley de la UE en lograr sus objetivos sin obstaculizar la innovación será un factor crítico. Si la ley logra un equilibrio entre ética, protección ciudadana y fomento de la innovación, podría convertirse en un modelo atractivo para otros países", finaliza.

Redactora de Tecnología

Redactora de Tecnología, especializada en inteligencia artificial y ciberseguridad.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.