ChatLLaMA: así es el nuevo chatbot basado en la IA de Meta, 15 veces más eficiente que ChatGPT

Nebuly, una empresa de optimización de IA ha presentado ChatLLaMA, la primera implementación de código abierto del modelo de lenguaje LLaMA (de Meta) basada en RLHF, al más puro estilo ChatGPT.

Como ya anunciamos hace tan solo unos días, Meta lanzó un nuevo modelo de lenguaje de inteligencia artificial con nombre LLaMA, destinado a ayudar a los científicos e ingenieros a explorar aplicaciones para la inteligencia artificial, como responder preguntas y resumir documentos.

El lanzamiento de Meta de su nuevo modelo, que fue desarrollado por su equipo Fundamental AI Research (FAIR), se produce cuando las grandes empresas de tecnología y algunas nuevas compiten por promocionar los avances en técnicas de inteligencia artificial e integrar la tecnología en productos que se puedan comercializar.

Aquí encontramos grandes ejemplos como ChatGPT de OpenAI, Microsoft Bing AI y el inédito Bard de Google. Con esta novedad de Meta, Mark Zuckerberg afirma que se distingue en positivos en varios aspectos de los modelos de la competencia como los parámetros de entrenamiento o poner sus modelos a disposición del público científico.

Con esto sobre la mesa, ahora todos hemos estado esperando el nacimiento de aplicaciones basadas en LLaMA y para nuestra suerte, ya tenemos una implementación basada en el aprendizaje reforzado con retroalimentación humana (RLHF) con nombre ChatLLaMA, desarrollado por la empresa Nebuly, dedicada a la optimización de IA.

ChatLLaMA, el nuevo chatbot con el modelo de lenguaje de Meta

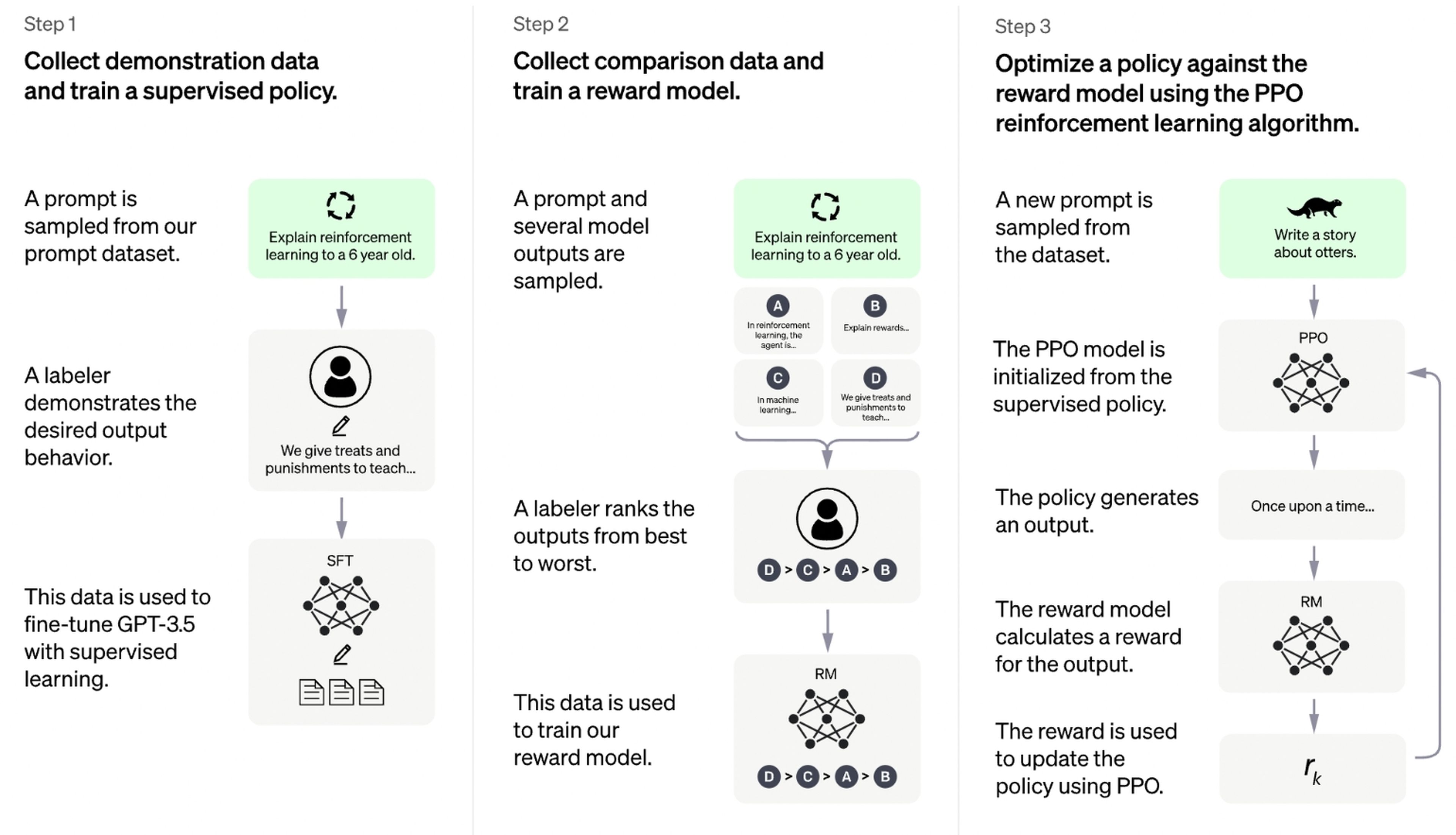

Para comprender a la perfección de qué estamos hablando, primero es necesario explicar qué es el RHLF sobre el que se basa ChatLLaMA. El aprendizaje por refuerzo a partir de la retroalimentación humana (RLHF) usa métodos de aprendizaje por refuerzo para mejorar directamente un modelo de lenguaje gracias al trabajo humano.

Y es que, decir que una de las principales razones detrás del increíble éxito y rendimiento de ChatGPT es su técnica de entrenamiento, que no es ni más ni menos que el aprendizaje reforzado a partir de la retroalimentación humana (RLHF).

Sabiendo ya esto, el punto clave de este chatbot basado en RHLF de Nebuly es que, al estar basado en LLaMA, supera con creces las capacidades de GPT-3 y, por lo tanto, ChatGPT. En concreto y tal y como especifican, "el proceso de entrenamiento y la inferencia de GPU única son mucho más rápidos y económicos al aprovechar el tamaño más pequeño de las arquitecturas LLaMA".

Esto quiere decir que es más rápido y sencillo de entrenar y, por ejemplo, la arquitectura de 13 mil millones de parámetros de LLaMA supera a GPT-3 a pesar de ser 10 veces más pequeña (175 mil millones de parámetros).

Con respecto a este punto, recordemos que LLaMA cuenta con cuatro modelos de diferentes parámetros (7 mil millones, 13, 33 y 65), con el objetivo de que escojas el modelo que más se ajuste a tus necesidades de desarrollo. Pues bien, ChatLLaMA es compatible con todas estas arquitecturas de modelos LLaMA de Meta, es decir está estandarizado.

Gracias a esto, obtendremos una mayor flexibilidad y selección de preferencias para el tiempo de entrenamiento y el rendimiento de tu desarrollo. Además, cuenta con soporte incorporado para DeepSpeed ZERO para acelerar el proceso de ajuste.

A esto hay que sumarle que, tal y como explican, hablamos de una implementación completa de código abierto que permite crear un servicio al estilo ChatGPT, pero basado en LLaMA. ChatLLaMA te permitirá entrenar fácilmente arquitecturas basadas en este modelo de lenguaje de Meta de manera similar a ChatGPT usando RLHF.

Conoce cómo trabajamos en ComputerHoy.

Etiquetas: Inteligencia artificialOrdenadores, Programación, Chat, Software