La compañía detrás de Tiktok lanza una herramienta de IA que imita voces y las alarmas saltan por el riesgo de estafas

Gettyimages/Thomson Reuters 2022

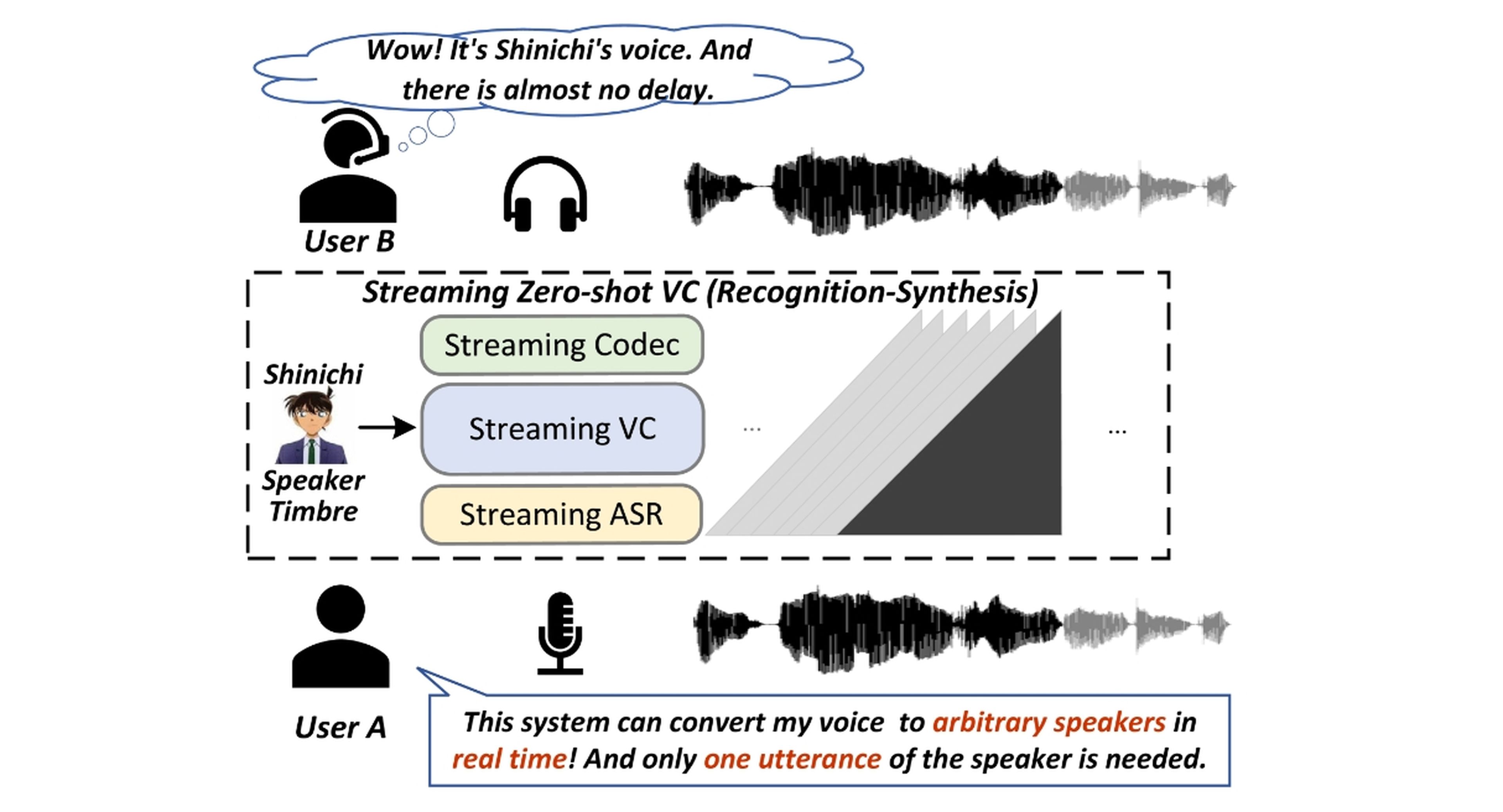

- ByteDance ya cuenta con StreamVoice, una herramienta de IA capaz de emular cualquier voz en tiempo real y en varios idiomas de una forma impresionante.

- Los investigadores ya han mostrado una gran preocupación por la cantidad de casos de fraudes y suplantación de identidad que esta herramienta puede dar lugar.

La gigante tecnológica china, ByteDance, la empresa que se esconde detrás de TikTok, vuelve a ser portada de medios al lanzar StreamVoice. Esta nueva herramienta, impulsada por inteligencia artificial generativa, permite a los usuarios transformar sus voces a su gusto y con una enorme calidad para imitar a otras personas.

Detrás de esta herramienta se esconde LLaMA, basada en el modelo de lenguaje grande de Meta, un modelo bastante importante y protagonista en esta era de la inteligencia artificial. También incorpora código fuente abierto de AudioDec de Meta.

Por otro lado, comentan que StreamVoice ha sido entrenada con un conjunto de datos de habla mandarín y multilingües, que incluyen inglés, finlandés y alemán, lo que permite que esta herramienta pueda adaptarse a cualquier idioma.

En este caso, la producción de esa imitación se realiza a velocidad de transmisión en directo, con una sorprendente latencia de apenas 124 milisegundos, superando algunas limitaciones de otras herramientas de conversión de voz mediante inteligencia artificial.

arxiv.org

Una gran herramienta de IA que podría dar lugar a todo tipo de estafas y 'deepfakes'

Aunque por ahora StreamVoice está fuera del alcance de todos, lo cierto es que su creación ha puesto los pelos de punta a algunos expertos.

En pocas palabras, la herramienta hace realmente sencilla la creación sin esfuerzo de deepfakes, imitaciones audiovisuales que replican las voces de figuras públicas, una tendencia que ha protagonizado 2023 y que se espera que siga siendo un problema a resolver en 2024.

Algunos ejemplos han sido la imitación de voces de Joe Biden y la reciente falsa llamada instando a la gente a no votar en las primarias de New Hampshire, la cantante Taylor Swift o incluso del Presidente de Ucrania, Volodímir Zelenski, con las implicaciones a nivel mundial que podría tener esto.

Los investigadores reconocen riesgos potenciales, como la difusión de información errónea o incluso el fraude telefónico. La capacidad de transformar la voz de un usuario en tiempo real podría ser explotada por estafadores para realizar llamadas fraudulentas que parezcan reales.

Redactora de Tecnología

Redactora de Tecnología, especializada en inteligencia artificial y ciberseguridad.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.