¿Los chatbots de la IA se inventan las respuestas? Esta podría ser la solución, según expertos

Enrique Luque de Gregorio

Antiguos trabajadores del MIT han desarrollado una herramienta capaz de arreglar un problema recurrente: las llamadas "alucinaciones de la IA". Según ellos, así usar esta tecnología puede aumentar su eficacia.

Si te interesa mínimamente la tecnología, es bastante probable que hayas trasteado en alguna ocasión con los chatbots de la inteligencia artificial.

Al fin y al cabo, herramientas como ChatGPT o Copilot están completamente de moda en estos momentos. De ser así, habrás comprobado que sus respuestas no son siempre demasiado fiables.

De hecho, mucha gente lleva tiempo acusando a este tipo de propuestas de inventarse las respuestas que dan a los usuarios. No todas, claro, pero sí muchas de ellas, variando además en función a lo que cada usuario pregunta específicamente.

¿Cómo podría solucionarse este problema? Unos expertos han decidido profundizar en el asunto y creen haber encontrado la respuesta.

Cuando la IA hace de las suyas

Seguramente hayas escuchado hablar de las llamadas “alucinaciones de la IA”. Básicamente, no dejan de ser aquellos casos en los que un modelo de IA genera resultados que son incorrectos, incoherentes o directamente imaginarios. Lo cual, es cierto, pasa con frecuencia, y puede convertirse en un problema en según qué contextos.

Hay que tener presente que aunque mucha gente utiliza chatbots como ChatGPT sin demasiada profundidad, la IA se emplea para todo tipo de tareas, desde usos en la industria de la medicina hasta corregir exámenes. Por no hablar de aplicaciones políticas. Es decir, que sus alucinaciones pueden salir muy caras en algunos momentos específicos.

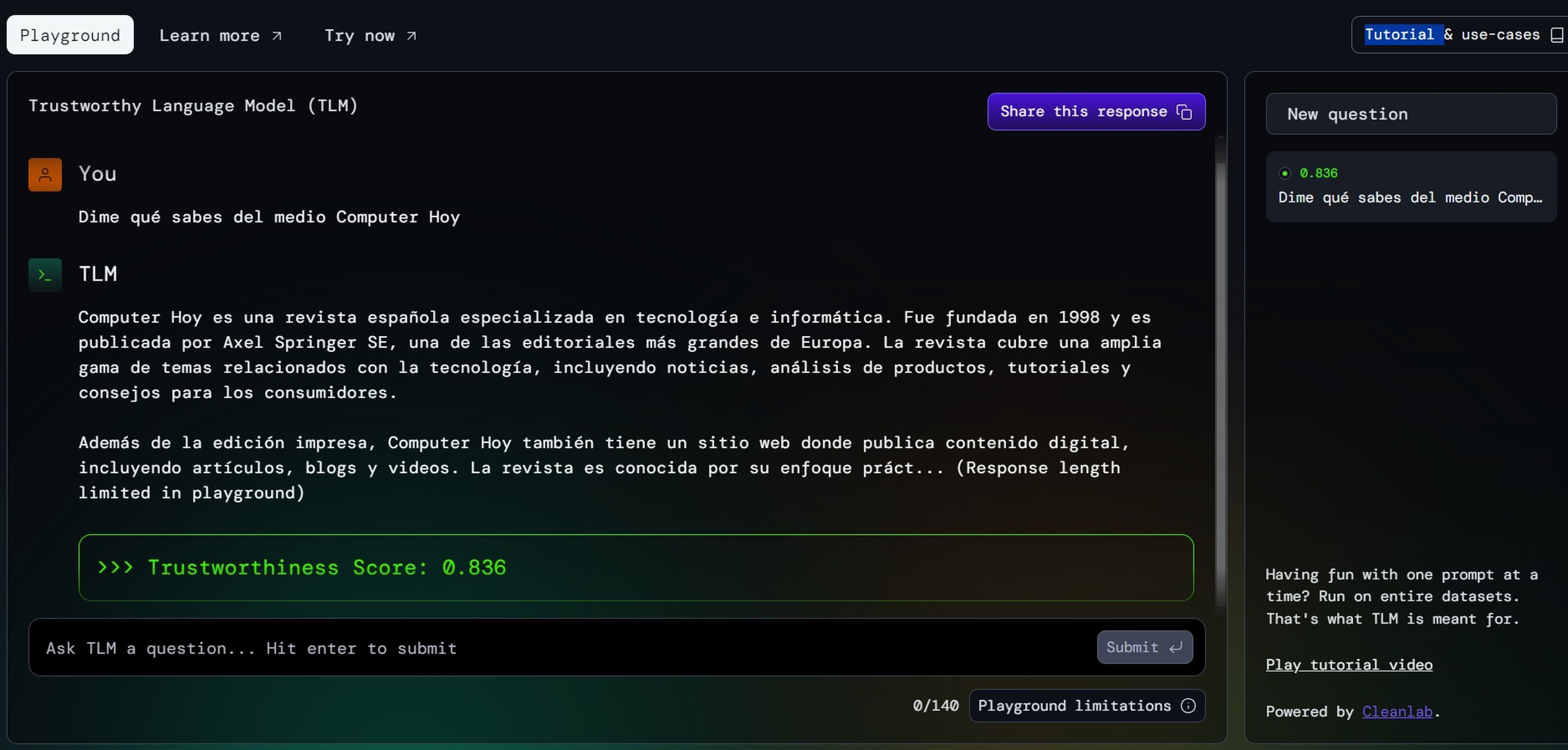

Conscientes de ello, desde Cleanlab, una startup por antiguos miembros del MIT, han decidido tomar cartas en el asunto. ¿Cómo? Pues desarrollando una herramienta capaz de determinar cuál es el grado de fiabilidad de los chatbots de inteligencia artificial. De esta forma, los usuarios podrían tener más o menos claro si algo tiene posibilidades de resultar cierto.

En realidad, su funcionamiento es muy sencillo, ya que solo es necesario preguntar algo a la inteligencia artificial y la respuesta llega acompañada de un porcentaje entre 0 y 1. Por ejemplo, si fuese del 0,9, estaríamos hablando de que la conclusión sería bastante fiable.

Mejorando la fiabilidad de la IA

En este momento la herramienta TLM Playground está disponible para todos los usuarios, y es posible acceder a ella de manera gratuita desde este enlace. Gracias a ella, quizá sea posible valorar mejor la respuesta de un chatbot antes de tomarla como correcta, por así decirlo.

Y es que, aunque las empresas desarrolladoras de este tipo de tecnología, empezando por la propia OpenAI, trabajan constantemente en mejorar la precisión de sus programas, cualquier inteligencia artificial sigue a día de hoy teniendo resultados erróneos, o “alucinando” con mucha frecuencia. Incluso en preguntas verdaderamente simples.

Algunos expertos parecen coincidir en que este problema es más acentuado cuando se trata de las versiones gratuitas de los chatbots, corrigiéndose sensiblemente en las de pago. Pero lo cierto es que en estos momentos no hay ninguna que sea del todo convincente.

Quizá la propuesta de los ex miembros del MIT puede ser realmente un primer paso para solucionarlo. Al menos, hasta que la fiabilidad de la IA sea más alta, si es que logra serlo en el futuro.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.