Adobe vende imágenes creadas con IA de la guerra entre Israel y Hamás y acaban en las noticias, pero ¿de quién es la culpa?

Adobe

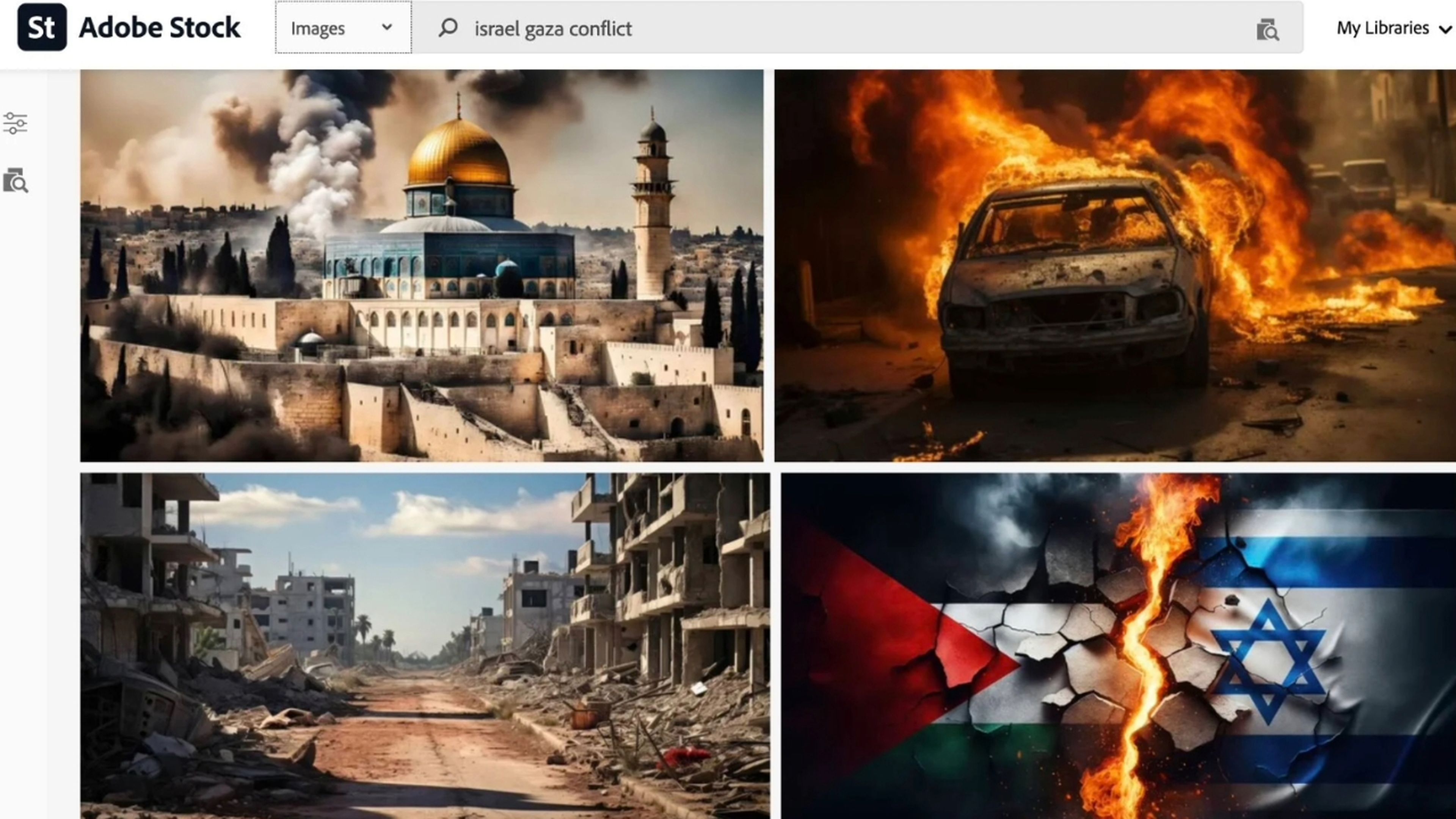

- Fotografías generadas por IA del actual conflicto entre Israel y Hamás no solo se venden a través Adobe Stock, sino que algunos editores de noticias están comprando y usándolas en artículos como si fueran reales.

- Empresas de tecnología y medios como el propio Adobe, Microsoft, la BBC y el New York Times están intentando detener este uso indebido que acaba engañando a la población.

- Cómo conectar una memoria USB a tu móvil Android para transferir archivos en un instante.

Adobe ya ofrece la posibilidad de crear imágenes por IA en su plataforma Adobe Stock. Esto es algo positivo, sin embargo, el problema viene cuando esta función ha sido utilizada para representar el conflicto ficticio entre Israel y Hamás, siendo además presentadas como reales en medios de comunicación. Este hecho fue reportado por primera vez por Crikey, un medio australiano.

Para contextualizar, el año pasado, Adobe abrió sus puertas a artistas que emplean herramientas de aprendizaje automático para producir imágenes realistas de personas. Esto proporciona a los creadores la oportunidad de ganar algo de dinero cada vez que sus imágenes se registran y descargan.

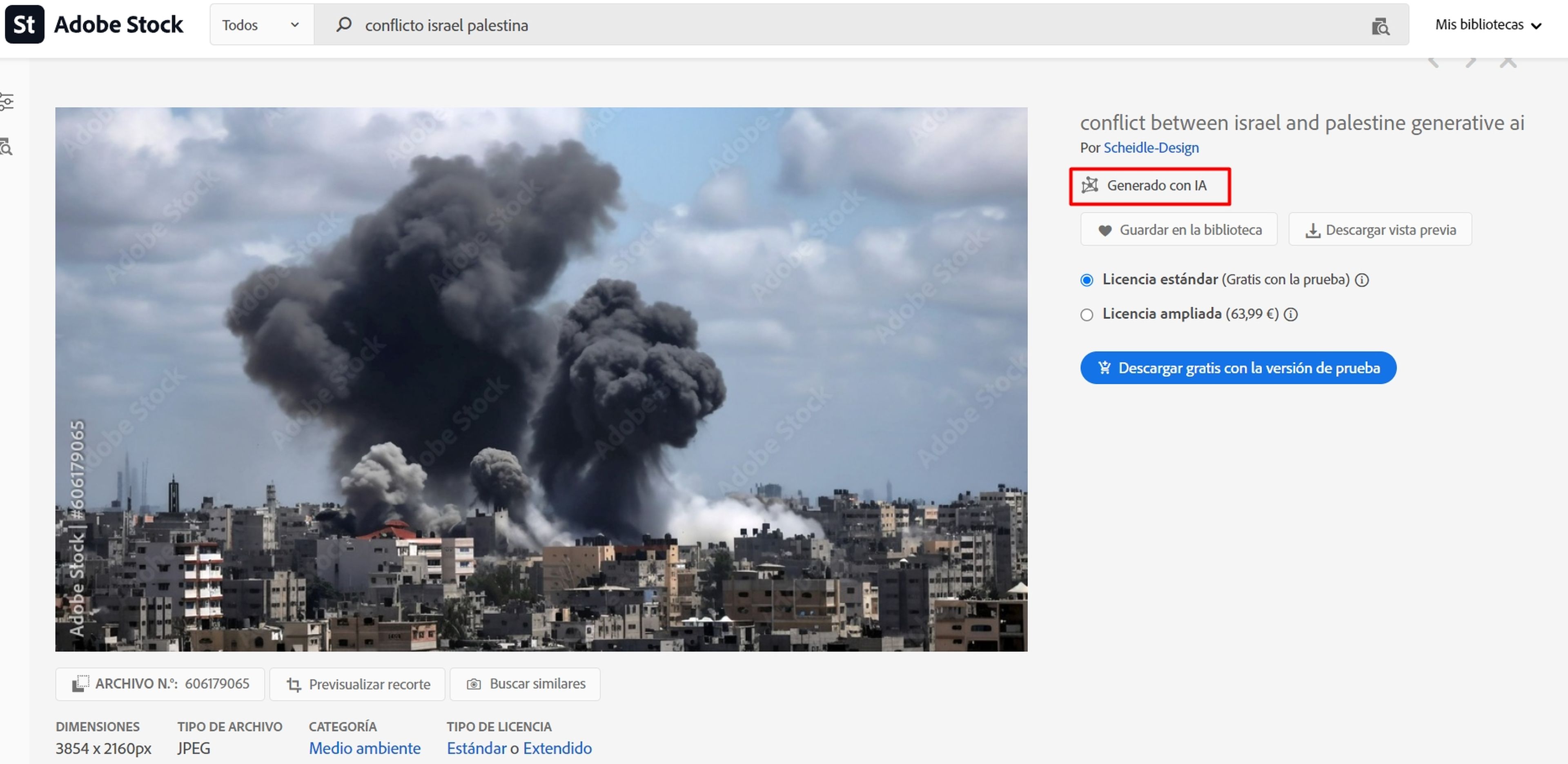

Sin embargo, esta libertad también ha dado lugar a la creación de imágenes ficticias que representan el cruel conflicto actual. Aunque estas se marcan como "generadas por IA" en la biblioteca de Adobe Stock, la etiqueta a menudo se omite al descargarlas y utilizarlas en otros lugares, incluyendo en artículos de medios.

Por ejemplo, una imagen titulada "Conflicto entre Israel y Hamás generado por IA", que muestra columnas de humo subiendo desde edificios, ha sido utilizada en numerosos artículos en Internet como si fuera una imagen real.

Adobe Stock

Adobe responde a las críticas, pero ¿es realmente su culpa? Parece que no

"Adobe Stock es un mercado que requiere que todo el contenido de IA generativa esté etiquetado como tal cuando se presenta para obtener una licencia. Estas imágenes específicas se etiquetaron como IA generativa cuando se enviaron y se pusieron a disposición para obtener licencia de acuerdo con estos requisitos. Creemos que es importante que los clientes sepan qué imágenes de Adobe Stock se crearon utilizando herramientas de inteligencia artificial generativa", explica la compañía a un medio.

Los expertos ya han advertido en muchas ocasiones sobre el potencial de la IA para propagar información falsa, y a medida que aumenta la producción de este tipo de contenido, la tarea de ver qué es real y qué no, cada vez es más compleja.

En el otro extremo de esos medios que hacen uso de estas imágenes falsas y engañan a la población, muchos equipos están trabajando en enfoques como el marcado de agua en el contenido generado por IA, con el objetivo de ayudar a los usuarios a diferenciar entre lo real y lo falso.

Como respuesta a este problema, se ha creado la Iniciativa de Autenticidad de Contenido, en la que participan organizaciones tecnológicas y de medios de comunicación como Adobe, Microsoft, la BBC y el New York Times. Buscan implementar y respaldar las Credenciales de Contenido, que emplean metadatos para identificar la fuente de una imagen, ya sea generada por una persona o una IA.

No cabe duda de que Adobe poco tiene que ver en todo este tema. Aunque ha establecido etiquetas claras de "generado por IA", la omisión de esta información al utilizar estas imágenes en medios no cabe duda de que crea una gran confusión. Los medios juegan un papel clave en la verificación y autenticidad de la información que comparten y parece que algunos se están saltando ese paso.

Redactora de Tecnología

Redactora de Tecnología, especializada en inteligencia artificial y ciberseguridad.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.