Elon Musk y otros expertos preocupados por el descontrolado desarrollo de la IA

A través de una carta, más de 1.000 expertos en IA piden una pausa de 6 meses en los sistemas de entrenamiento más potentes que el modelo GPT-4 recientemente lanzado por OpenAI, citando riesgos potenciales para la sociedad y la humanidad.

La inteligencia artificial se está apoderando del universo y se está convirtiendo en una tecnología con un crecimiento exponencial y prácticamente imparable. Es por eso que grandes expertos, filósofos, empresarios como Elon Musk y científicos quieren unir fuerzas para frenar su desarrollo de forma temporal.

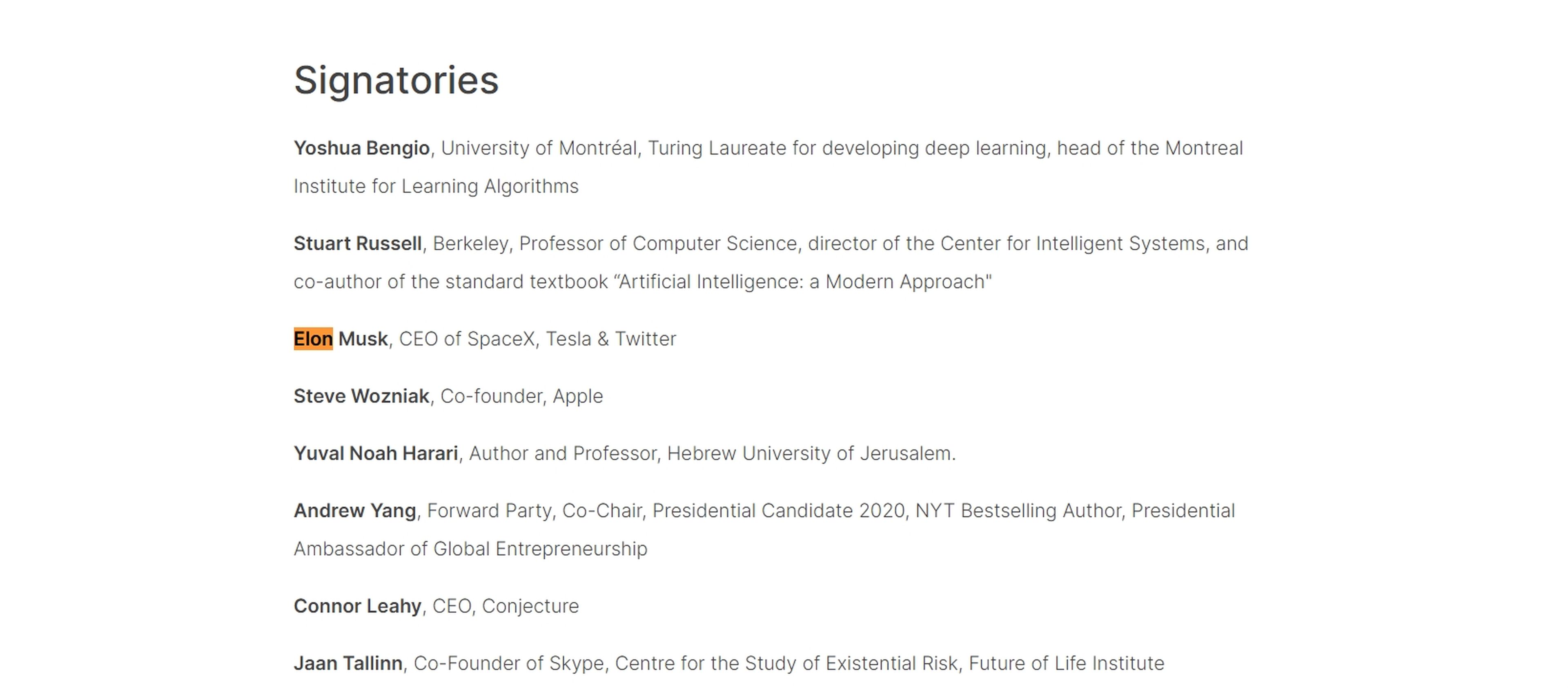

La carta, emitida por el Future of Life Institute sin fines de lucro y hasta el miércoles por la mañana, ha sido firmadas por más de 1.100 personas, incluidos Max Tegmark (Centro de Inteligencia Artificial e Interacciones Fundamentales del MIT), y empresarios tecnológicos como Elon Musk (SpaceX, Tesla, Twitter) o Steve Wozniak (co-fundador de Apple), entre muchos otros.

"Los poderosos sistemas de inteligencia artificial deben desarrollarse solo una vez que estemos seguros de que sus efectos serán positivos y sus riesgos serán manejables", se puede leer la carta.

Al señalar algunos de los riesgos de la IA, la carta denuncia la "carrera fuera de control para desarrollar y desplegar mentes digitales cada vez más poderosas que nadie, ni siquiera sus creadores, pueden entender, predecir o controlar de manera confiable" y la falta de “planificación y gestión” adecuada a la tecnología potencialmente peligrosa.

'Pausar experimentos gigantes de IA: una carta abierta'

La realidad es que el desarrollo de estos sistemas —como el novedoso modelo GPT-4 de OpenAI— ha tomado una velocidad cada vez mayor, inalcanzable por los sistemas de seguridad y casi a años luz de poder tomar conciencia de todo lo que está sucediendo.

Esto es algo que instituciones como la Europol alertan, advirtiendo sobre el posible uso indebido del sistema en intentos de 'phishing', desinformación y ciberdelincuencia.

Por supuesto y como era de esperar, Sam Altman, director ejecutivo de OpenAI, no ha firmado la carta y prefiere mantener alejado de este tipo de revueltas. La realidad es que siendo el CEO de la mayor empresa de inteligencia artificial del mundo, resulta bastante lógico.

La carta está totalmente disponible para su lectura y volver a recalcar que la publica el Future of Life Institute, que apoya "el desarrollo de instituciones y visiones necesarias para gestionar las tecnologías que impulsan el mundo y permitir un futuro positivo" y tiene como objetivo "reducir daños a gran escala, catástrofes y riesgos existenciales resultantes de accidentes o mal uso intencional de tecnologías transformadoras".

Redactora de Tecnología

Redactora de Tecnología, especializada en inteligencia artificial y ciberseguridad.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.