¿Qué son los modelos de lenguaje?

Los modelos de lenguaje, claves en el procesamiento de texto, han revolucionado la forma en que las máquinas comprenden y generan texto. En este reportaje y vídeo aprenderás qué son y sus grandes beneficios.

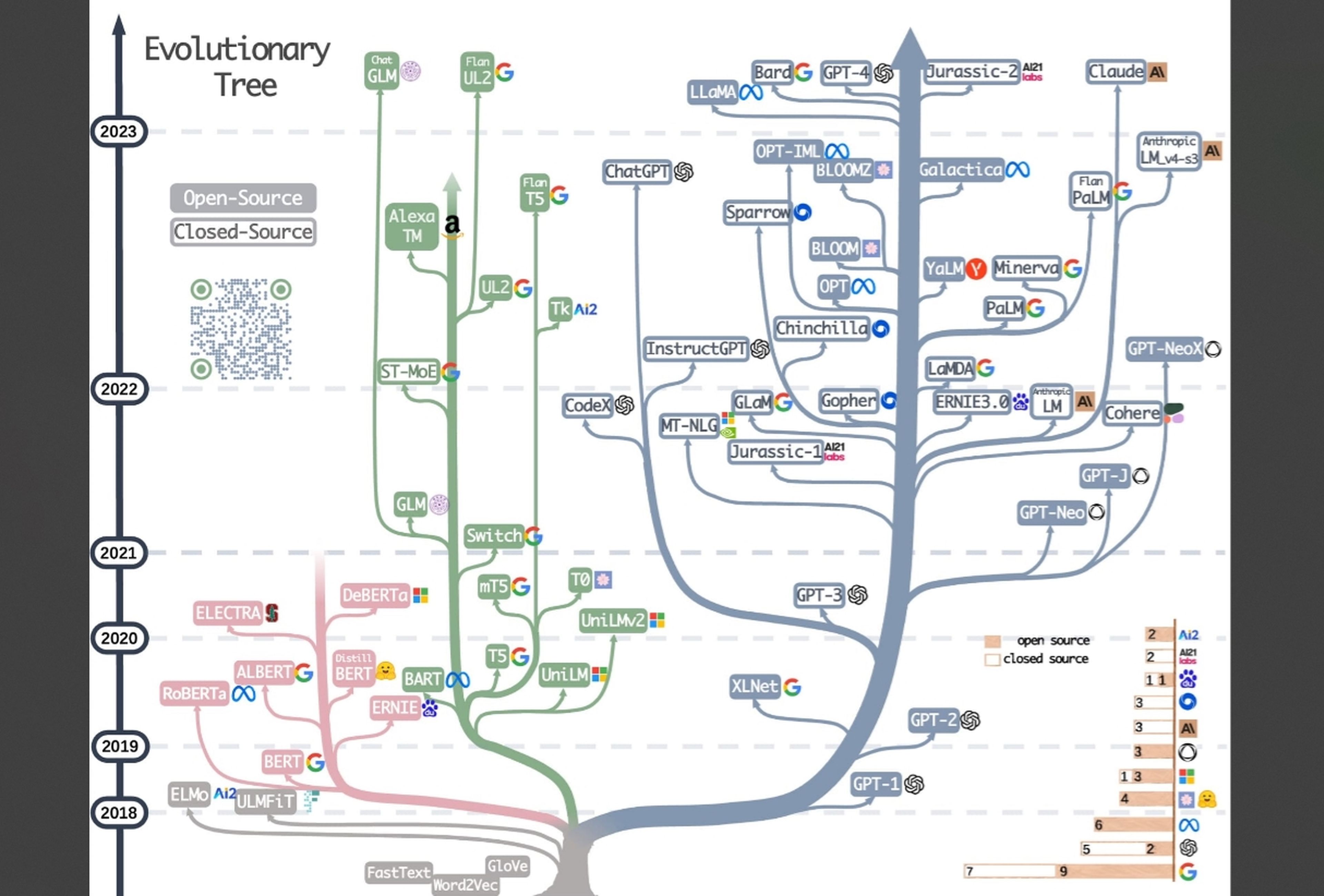

En la era actual de la inteligencia artificial, los modelos de lenguaje se han convertido en un tema de gran relevancia. Estos representan una innovación de gran calado en el campo de la IA y están siendo ampliamente utilizados en diversas aplicaciones y tecnologías.

Se han vuelto fundamentales en el desarrollo de sistemas de procesamiento de texto y habla, así como en la interacción entre humanos y máquinas. Su capacidad para comprender y generar lenguaje similar al humano ha transformado la forma en que la genete se comunica y utiliza la tecnología en su vida diaria.

Estos modelos han experimentado un crecimiento impresionante en términos de rendimiento y aplicabilidad. Su utilización se ha expandido a campos como la traducción automática, el reconocimiento de voz o la generación de texto e imágenes.

Sin embargo, junto con su crecimiento y aplicaciones, también surgen desafíos y consideraciones éticas en torno a los modelos de lenguaje. La necesidad de abordar el sesgo en el lenguaje, la privacidad de los datos y las implicaciones sociales de estas tecnologías se vuelve cada vez más importante.

- ¿Qué es un modelo de lenguaje?

- Dos enfoques principales cuando se trata de modelado de lenguaje

- Usos, aplicaciones y tecnologías que los utilizan

- 4 modelos de lenguaje que necesitas saber

¿Qué es un modelo de lenguaje?

Un modelo de lenguaje es un tipo de modelo estadístico o computacional que se utiliza para comprender y generar texto en lenguaje natural. Este utiliza el aprendizaje automático o Machine Learning para realizar una distribución de probabilidad sobre las palabras utilizadas para predecir la siguiente palabra más probable en una oración en función de la entrada anterior.

Para entenderlo mejor, un modelo de lenguaje es como una "máquina" inteligente que aprende a entender y generar texto como lo hacemos los seres humanos. Puedes pensar en él como un asistente virtual o una aplicación en tu móvil que puede hablar y escribir de manera natural.

Este modelo se entrena utilizando grandes cantidades de texto para aprender cómo funcionan las palabras en conversaciones, creación de historias y otros tantos de casos.

Por ejemplo, imagina que estás escribiendo un mensaje de texto en tu móvil y empiezas a escribir "Hola, ¿cómo...?". Tu móvil, gracias al modelo de lenguaje, puede predecir que probablemente quieras escribir "Hola, ¿cómo estás?". Esto se debe a que el modelo ha analizado millones de conversaciones y ha aprendido qué palabras suelen seguir a otras.

El modelo de lenguaje también puede generar texto de manera autónoma. Por ejemplo, si le das una frase de inicio como "Había una vez en un país muy lejano", el modelo podría generar una historia completa basada en esa frase de inicio. Esto es posible porque ha aprendido las estructuras y los patrones del lenguaje a partir de los textos con los que fue entrenado.

Dos enfoques principales cuando se trata de modelado de lenguaje

Existen varios tipos de modelos de lenguaje, pero a grandes rasgos, se pueden clasificar en 2 categorías principales: modelos de lenguaje basados en reglas y modelos de lenguaje estadísticos o de aprendizaje automático.

Modelos de lenguaje basados en reglas

Estos modelos utilizan reglas y estructuras gramaticales predefinidas para comprender y generar texto. Se basan en un conjunto de reglas gramaticales y semánticas diseñadas manualmente por lingüistas y expertos en lenguaje.

Estas reglas definen la sintaxis y la semántica del lenguaje en cuestión. Los modelos de lenguaje basados en reglas son más comunes en sistemas de procesamiento del lenguaje natural más antiguos y están limitados por la complejidad de definir todas las reglas necesarias para un lenguaje completo.

El problema de este tipo de modelo reside en que puede ser un proceso muy laborioso y complejo. Además, estos pueden tener dificultades para manejar la ambigüedad y las variaciones en el lenguaje, ya que no pueden adaptarse de forma automática a nuevas situaciones o aprender de datos no incluidos en las reglas predefinidas.

Modelos de lenguaje probabilísticos o de aprendizaje automático ('Machine Learning')

Estos modelos se basan en el análisis estadístico de grandes cantidades de texto para aprender las propiedades y patrones del lenguaje. Pueden utilizar diferentes enfoques, como modelos n-grama, redes neuronales recurrentes (RNN) y modelos transformer, entre otros.

Los modelos n-grama para que se entienda a la perfección es un tipo de modelo de lenguaje que ayuda a predecir qué palabras son más probables de aparecer después de otras en un texto. Imagina que estás leyendo una frase y quieres adivinar la siguiente palabra. Un modelo n-grama te ayuda a hacer esa predicción.

La idea principal detrás de este es que la probabilidad de que aparezca una palabra en un contexto dado depende de las palabras que la preceden. Por ejemplo, si las últimas 2 palabras en una oración son "estoy feliz", es más probable que la siguiente palabra sea algo como "ahora" o "porque" en lugar de "perro" o "sol".

Las redes neuronales recurrentes (RNN) son una mejora en este tema. Dado que los RNN pueden ser una red basada en celdas de memoria a corto plazo (LSTM) o una unidad recurrente cerrada (GRU), tienen en cuenta todas las palabras anteriores al elegir la siguiente palabra.

El principal inconveniente de las arquitecturas basadas en RNN se deriva de su naturaleza secuencial y su memoria a corto plazo. En consecuencia, los tiempos de entrenamiento se disparan para secuencias largas porque no hay posibilidad de paralelización. La solución a este problema es la arquitectura del transformer.

Gracias a estos se han mejorado los modelos de lenguaje al permitirles comprender mejor las relaciones entre las palabras en un texto, sin importar cuán lejos estén entre sí. También pueden aprender automáticamente y adaptarse a diferentes tareas y situaciones, lo que ha llevado a una mejora en la precisión y en la calidad del texto generado.

Intervienen en una amplia variedad de aplicaciones y tecnologías

1. Asistentes virtuales: son fundamentales en asistentes virtuales como Siri, Google Assistant o Amazon Alexa. Estos utilizan modelos de lenguaje para entender y responder a comandos de voz, realizar búsquedas, proporcionar información y realizar tareas como enviar mensajes o hacer llamadas.

2. Traducción automática: son esenciales para los sistemas de traducción automática. Ayudan a traducir texto de un idioma a otro de manera más precisa y natural. Un ejemplo más que conocido es Google Translate o DeepL.

3. Corrección de texto: se utilizan en herramientas de corrección de texto, como los correctores ortográficos y gramaticales. Estas herramientas utilizan el modelo para identificar y corregir errores comunes en la escritura, mejorando la calidad y precisión del texto.

4. Generación de texto: pueden generar texto coherente y relevante en diferentes contextos como el claro ejemplo de ChatGPT, Bard o Bing Chat. Estos se utilizan también en aplicaciones para la generación de subtítulos automáticos de vídeos o la creación de contenido para redes sociales.

5. Autocompletado de texto: se emplean en funciones como la sugerencias de palabras en los teclados de smartphones o las recomendaciones de búsqueda en Google, por ejemplo. Ayudan a predecir y sugerir palabras y frases a medida que se escribe.

4 modelos de lenguaje que necesitas saber

GPT-4

El último lanzamiento de OpenAI, GPT-4, es el modelo de inteligencia artificial más poderoso e impresionante hasta el momento de la compañía detrás de ChatGPT y DALL-E.

Ya disponible para algunos usuarios de ChatGPT, GPT-4 ha sido entrenado en una red de supercomputación en la nube masiva que vincula miles de GPU, diseñadas a medida y construidas en conjunto con Microsoft Azure.

La compañía ha dado a conocer los poderes del modelo de lenguaje en su blog diciendo que es más creativo y colaborativo que nunca. Mientras que ChatGPT con tecnología GPT-3.5 solo aceptaba entradas de texto, GPT-4 también puede usar imágenes para generar subtítulos y análisis.

El cambio más notable es que es multimodal, lo que le permite comprender más de una modalidad de información. GPT-3 y GPT-3.5 de ChatGPT estaban limitados a la entrada y salida de texto, lo que significa que solo podían leer y escribir. Sin embargo, GPT-4 puede recibir imágenes y pedirle que comprenda esta información.

En cuanto a las diferencias con los anteriores modelos, una que hay que recalcar desde un comienzo se basa en el concepto de “Más poder en una escala más pequeña”. OpenAI, tal y como acostumbra, es muy cautelosa a la hora de ofrecer toda la información y los parámetros utilizados para entrenar en este caso a GPT-4.

LaMDA

El modelo LaMDA (Language Model for Dialogue Applications) de Google es tan preciso que supuestamente convenció a un ingeniero de inteligencia artificial de que tenía sentimientos.

Cuando no está asustando a los trabajadores, el modelo puede generar un diálogo conversacional de forma libre, en comparación con las respuestas basadas en tareas que suelen generar los modelos tradicionales.

Esto se debe a que LaMDA fue entrenada en diálogo. Según Google, su enfoque permitió que el modelo captara los matices que distinguen una conversación abierta de otras formas de lenguaje.

Presentado por primera vez en el evento I/O de la compañía en mayo de 2021, Google planea usar el modelo en todos sus productos, incluido su motor de búsqueda, el Asistente de Google y la plataforma Workspace.

Y en su evento I/O de 2022, la compañía anunció expansiones a las capacidades del modelo a través de LaMDA 2. Según se informa, la última versión está más afinada que la original y ahora puede generar recomendaciones basadas en las consultas de los usuarios. LaMDA2 se entrenó en el modelo de lenguaje Pathways (PaLM) de Google, que tiene 540.000 millones de parámetros.

BERT

BERT (Bidirectional Encoder Representations from Transformers) es un modelo de lenguaje basado en la arquitectura transformer que ha revolucionado el procesamiento del lenguaje natural. Fue presentado por Google en 2018 y se destaca por su capacidad para capturar el contexto y el significado de las palabras de manera profunda.

A diferencia de los modelos de lenguaje tradicionales que se entrenan de manera unidireccional, BERT utiliza un enfoque bidireccional. Esto significa que tiene la capacidad de ver tanto las palabras anteriores como las posteriores a la palabra en cuestión durante el entrenamiento.

Esta bidireccionalidad ayuda a BERT a comprender el contexto de una palabra y capturar mejor las relaciones complejas entre las palabras en una oración.

BERT se entrena en grandes cantidades de texto sin etiquetar en un proceso llamado "preentrenamiento". Durante este el modelo aprende a predecir palabras ocultas en una oración utilizando el contexto dado por las palabras circundantes. Esta tarea de previsión de palabras ocultas se conoce como Masked Language Modeling (MLM).

LLaMA

LLaMA (Large Language Model Meta AI) es un modelo de la compañía Meta presentado el 25 de febrero de 2023 que se basa en la arquitectura del transformador. Al igual que otros modelos de lenguaje destacados, LLaMA funciona tomando una secuencia de palabras como entrada y prediciendo la siguiente palabra, generando texto de forma recursiva.

Lo que distingue a LLaMA es su capacitación en una amplia gama de datos de texto disponibles públicamente que abarca numerosos idiomas y sus modelos están disponibles en varios tamaños: parámetros 7B, 13B, 33B y 65B, y puedes acceder a ellos en Hugging Face.

Como has podido ver, los modelos de lenguaje son herramientas clave en el procesamiento del lenguaje natural, permitiendo comprender y generar texto de manera efectiva y su relevancia radica en la capacidad que tiene para transformar la forma en que interactuamos con el lenguaje, facilitando la comunicación humana y abriendo nuevas posibilidades en el ámbito digital.

Redactora de Tecnología

Redactora de Tecnología, especializada en inteligencia artificial y ciberseguridad.

Otros artículos interesantes:

Conoce cómo trabajamos en Computerhoy.